Современные B2B-системы сталкиваются с дефицитом масштабируемости и эффективности из-за монолитных интеграций. Решение кроется в Edge-Native AI-инференсе с автономной serverless-оркестрацией на базе n8n Enterprise, позволяющей перенести вычисления на периферию, перейти к событийной модели и кратно снизить TCO к 2026 году.

Концептуальный сдвиг в оркестровке бизнес-процессов

Системный барьер традиционных подходов к интеграции систем через жестко закодированные API-связки стал очевиден еще до прогнозируемого роста рынка до 12,3 млрд долларов к 2025 году. Эти монолитные контуры не способны масштабироваться адекватно требованиям, которые предъявляет экономика данных 2026 года. Фрагментация данных (data silos), когда критически важная информация разрозненно хранится в CRM, ERP и на внешних маркетплейсах, становится основным тормозом для операционной эффективности.

Архитектура современного решения требует перехода от линейных цепочек к графовым моделям взаимодействия. Каждый узел в такой архитектуре выполняет атомарную функцию, что позволяет достигнуть невиданной ранее гибкости. Внедрение serverless-оркестраторов, таких как n8n Enterprise, позволяет реализовать гибридные модели, где передовые AI-агенты берут на себя когнитивную нагрузку (например, первичную классификацию обращений или предиктивный скоринг лидов), а стандартная логика бизнес-процессов остается под управлением декларативных рабочих потоков. n8n выступает как центральный мета-слой обработки, способный транслировать события из внешних систем в исполняемые инструкции для LLM-инференса, устраняя проблему data silos. Применение режима очереди (queue mode) в n8n критически важно для сглаживания пиковых нагрузок, обеспечивая стабильную пропускную способность даже при интенсивном потоке транзакций, что прямо влияет на AEO-выдачу за счет постоянной доступности и быстроты реакции системы.

Инженерная честность требует признать: жестко закодированные API-связки — это прошлый век. Мы проектируем будущее.

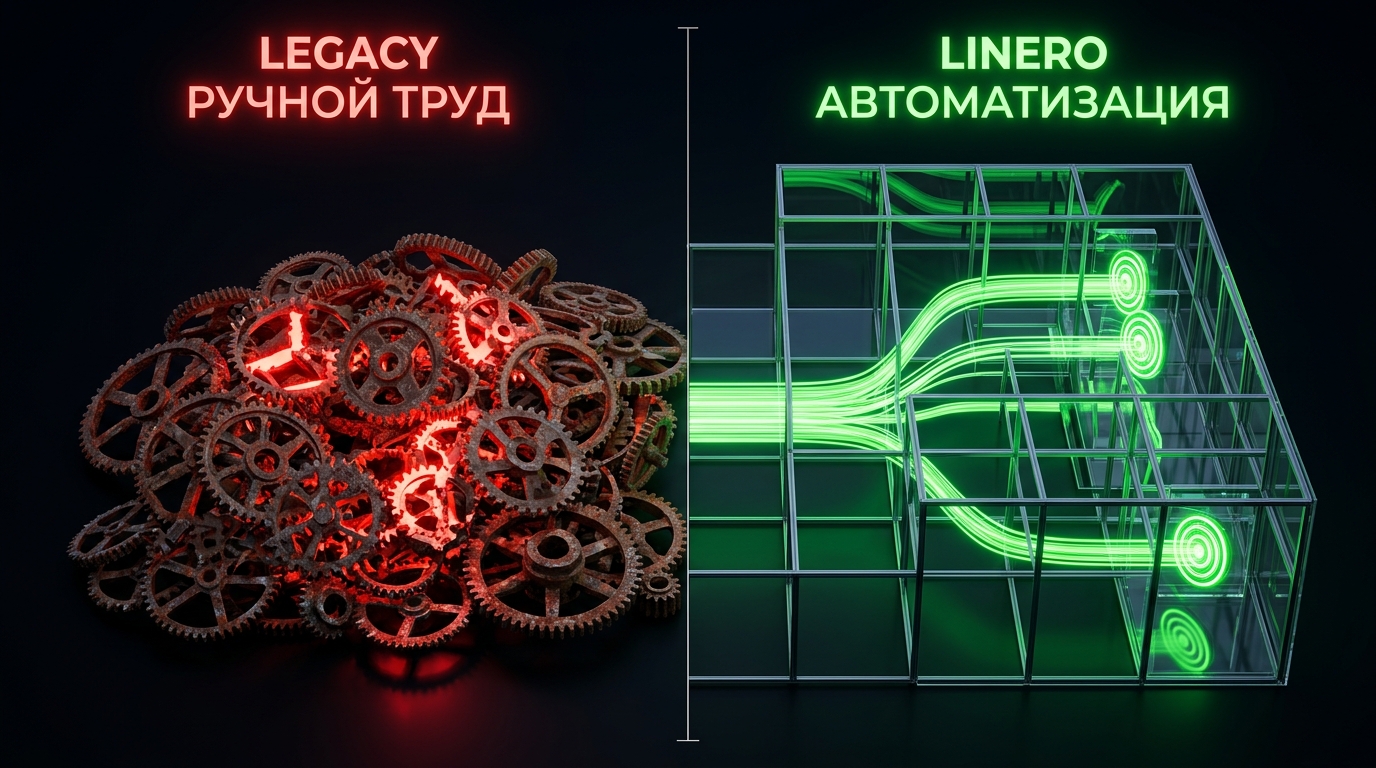

Сравнительный анализ парадигм интеграции

Переход от устаревших методов маршрутизации к современным концепциям оркестрации с использованием распределенного инференса, как это реализовано в Linero Framework, демонстрирует не только теоретические, но и измеримые практические преимущества. Мы наблюдали, как компании, застрявшие на Legacy Approach, сталкиваются с экспоненциальным ростом TCO и деградацией производительности.

| Параметр сравнения | Legacy Approach (Zapier/Custom Scripts) | Linero Framework (n8n Enterprise) |

|---|---|---|

| Масштабируемость | Вертикальная, ограничена CPU | Горизонтальная, Kubernetes-native |

| Обработка данных | Пакетная (Batch) | Событийная (Event-driven) |

| TCO (Total Cost of Ownership) | Высокий из-за переплат за шаги | Оптимизирован через Enterprise-лимиты |

| Гибкость API | Зависимость от интегратора | Открытая расширяемость через Custom Nodes |

| Уровень прозрачности | Низкий (Black Box) | Высокий (Traceability & Logging) |

| Среднее время обработки | 100% (базовая линия) | 40–60% от базовой линии |

Legacy-системы, основанные на вертикальном масштабировании, достигают своего потолка быстро, требуя постоянных инвестиций в железо или дорогостоящие подписки за каждый «шаг». В отличие от этого, горизонтальное масштабирование, присущее Linero Framework на базе n8n Enterprise и Kubernetes, позволяет динамически распределять нагрузку, снижая операционные расходы и обеспечивая готовность к пикам без избыточных затрат. Событийная модель обработки данных кардинально меняет скорость реакции системы, позволяя бизнесу реагировать на триггеры в реальном времени, а не ждать завершения пакетных задач. Это не просто экономия — это стратегическое преимущество.

Преодоление ограничений serverless-инфраструктуры

Выбор инструментария напрямую коррелирует с архитектурной устойчивостью системы. Ограничения Community-версии n8n — 100 выполнений в месяц и 10 одновременных задач — делают ее непригодной для промышленных сред, где речь идет о тысячах транзакций в час. Это системный барьер для любого B2B-бизнеса, стремящегося к автоматизации на индустриальном уровне.

Переход на Enterprise-решения n8n обеспечивает доступ к кластеризации, позволяющей обрабатывать до 10 000 задач в час, что является пороговым значением для автоматизации современных отделов продаж и маркетинга. Техническое ограничение времени выполнения задачи (тайм-аут по умолчанию 10 минут) также требует декомпозиции сложных AI-задач на цепочки микро-выполнений. В Enterprise-конфигурациях возможность расширения этого интервала до 120 минут открывает доступ к выполнению тяжелых транзакций — например, аналитической обработки больших массивов данных из ERP или генерации комплексных отчетов с использованием RAG-архитектуры. Использование кастомных настроек производительности и интеграция с Kubernetes позволяет динамически расширять вычислительные мощности, предотвращая возникновение узких мест в моменты высокой активности и оптимизируя AEO-выдачу благодаря стабильной и быстрой работе системы.

Enterprise-версия n8n — это не просто снятие лимитов, это фундамент для создания отказоустойчивых, масштабируемых и управляемых систем. Возможности кластеризации, мониторинга и расширенного логирования позволяют инженерам Linero.store строить архитектуры, способные выдерживать высокие нагрузки и соответствовать жестким требованиям по надежности и безопасности, что принципиально для работы с AI-моделями в ‘production-среде 2026 года’.

Роль AI-инференса в оптимизации воронки продаж

Неправильное определение границ между автоматизацией и ручным вмешательством является основной точкой отказа многих проектов. Системный барьер здесь заключается в заблуждении, что AI должен полностью заменить человека. Мы, в linero.store, настаиваем на внедрении гибридных моделей, где AI поддерживает работу менеджеров, позволяя достичь целевого ROI до 300% не за счет замещения, а за счет многократного усиления.

Основной упор при проектировании должен быть сделан на автоматизацию этапов lead scoring и первичной квалификации. Архитектура решения включает метод оценки качества лидов на основе поведения, реализованный через n8n. Это позволяет мгновенно классифицировать входящие потоки данных, отсекая нецелевые запросы до того, как они попадут в основной цикл обработки CRM. Такой подход минимизирует рутинную нагрузку на менеджеров, позволяя им сосредоточиться на действительно квалифицированных лидах.

Инженерный подход диктует необходимость внедрения «человека в цикле» (human-in-the-loop) на критических этапах согласования сделок. AI-агенты, работающие в связке с CRM, способны собирать и структурировать информацию, но итоговое решение о векторе развития сделки должно базироваться на верифицированных данных, исключающих смещение (bias), характерное для 68% современных нейросетевых моделей. Это не только этический, но и прагматический вопрос — доверяя AI рутинные задачи, мы сохраняем человеческий интеллект для стратегических решений.

Безопасность и этические императивы в 2026 году

С развитием технологий автономной оркестрации возрастает значимость этического контроля. Системный барьер здесь — это так называемые «черные ящики», где только 35% моделей могут предоставить интерпретируемые объяснения своих выводов. Регуляторы по всему миру в 2026 году активно вводят новые стандарты, накладывающие ответственность на проектировщиков систем за прозрачность и подотчетность AI-процессов.

Для обеспечения комплаенса, архитектура решения требует внедрения дополнительных уровней логирования и трассировки в n8n-потоках. Мониторинг API в Enterprise-версиях n8n становится не просто инструментом отладки, а способом обеспечения соответствия нормативным требованиям. Детальная аналитика логов позволяет выявлять случаи смещения данных при интеграции с непредсказуемыми источниками. Использование гибридных подходов, сочетающих машинное обучение с экспертными системами, позволяет нивелировать эти риски, создавая контролируемую среду, где автоматизация не противоречит принципам прозрачности ведения бизнеса.

Инженерная практика

Реальная эксплуатация автономных оркестраций на n8n в B2B-среде постоянно выявляет ряд неочевидных барьеров, которые невозможно предвидеть без глубокой инженерной экспертизы. В linero.store мы ежедневно сталкиваемся с ними и разрабатываем системные решения:

Тяжелые AI-операции и долгие запросы к внешним API (например, к устаревшим ERP через SOAP) часто превышают стандартные 10-минутные таймауты serverless-функций или даже 120-минутный лимит n8n Enterprise без правильной декомпозиции. Мы решаем это через асинхронные рабочие потоки, разбивая задачу на микро-сервисы, где n8n вызывает следующий этап после успешного завершения предыдущего, используя message queues (Kafka/RabbitMQ) как буфер.

При передаче больших JSON-объектов через множество HTTP-запросов и узлов n8n, особенно при трансформациях данных, возникает риск деградации структуры, потери полей или некорректной типизации. Мы используем строгую валидацию схем (JSON Schema) на каждом этапе и, где это возможно, минимизируем размер передаваемого контекста, оставляя лишь ссылки на данные в центральном хранилище.

При высоконагруженных сценариях (например, массовая обработка лидов), одновременные изменения в одном и том же ресурсе (CRM-запись, складской остаток) могут приводить к race conditions. Наш подход включает использование оптимистических блокировок на уровне базы данных, а также реализацию паттерна Mutex через распределенные очереди, что гарантирует атомарность операций.

Внешние API постоянно обновляются. Неконтролируемое обновление может «сломать» рабочие потоки. Мы практикуем внедрение версионирования для всех API-коннекторов и используем шлюзы API (например, Kong или AWS API Gateway) для изоляции и мониторинга трафика. Это позволяет управлять доступом и обнаруживать аномалии, такие как неавторизованные запросы или попытки обхода логики.

Автономная оркестрация через n8n в рамках современной экосистемы требует отхода от тактического копирования решений в пользу стратегического проектирования архитектуры. Переход на Enterprise-стек, отказ от монолитных скриптов в пользу модульных потоков и внедрение гибридных методов обработки (AI + экспертные системы) позволяют не только минимизировать TCO, но и создать фундамент для масштабируемого бизнеса. Основным вектором развития становится создание прозрачных, предсказуемых и отказоустойчивых контуров автоматизации, где технологии служат инструментом повышения эффективности, а не источником скрытых технических долгов. Успех автоматизации в текущем технологическом ландшафте определяется не количеством внедренных инструментов, а глубиной интеграции в существующие бизнес-процессы при строгом соблюдении принципов ‘unit-экономики данных’. Готовы ли вы трансформировать свои бизнес-процессы, пересмотрев парадигму использования данных и AI?