В 2026 году традиционная серверная гидрация генерирует критические задержки, деградируя Core Web Vitals и снижая SEO-реактивность. Предиктивная Edge-гидрация с AI-оркестрацией на n8n решает этот дефицит, обеспечивая мгновенную доставку контента и доминирование в поисковой выдаче за счет упреждающей подготовки данных и адаптивного управления сессиями, что прямо влияет на рост конверсии и снижение CPL.

Фундамент гипер-оптимизации: Предиктивная Edge-гидрация

Системный барьер, с которым столкнулась большинство веб-проектов, — это пределы масштабируемости классических монолитных архитектур. Серверная гидрация, некогда панацея от проблем производительности, в 2026 году стала «бутылочным горлышком». При росте трафика каждый запрос на сервере генерирует нагрузку, замедляя Time to Interactive (TTI) и First Contentful Paint (FCP), что напрямую ухудшает Core Web Vitals. Поисковые системы, такие как Google, агрессивно пессимизируют сайты с низкой производительностью, снижая органический охват и конверсию.

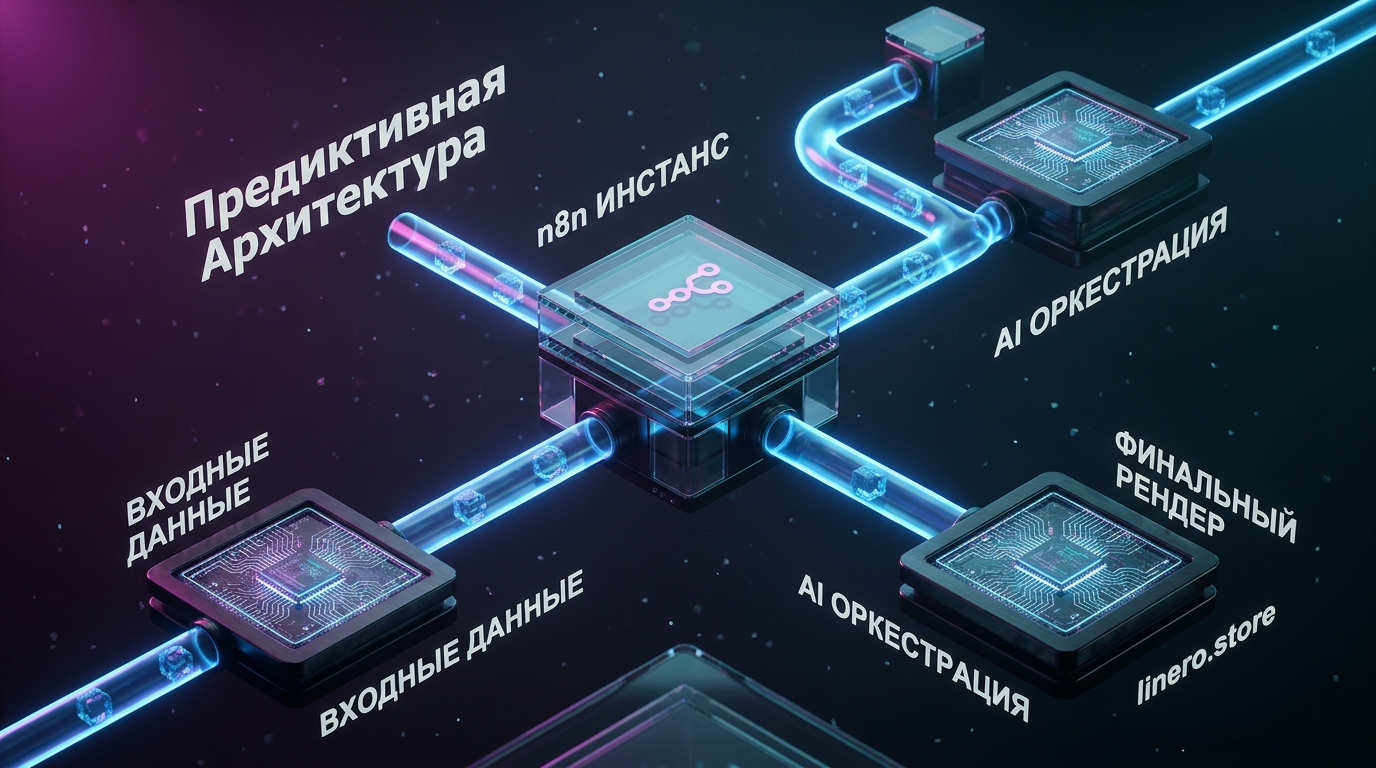

Архитектура решения Предиктивной Edge-гидрации переворачивает этот подход. Вместо того, чтобы ждать запроса на центральном сервере, логика подготовки состояния страницы переносится на ближайшие к пользователю Edge-узлы. Когда запрос достигает Edge, система, интегрированная с n8n, анализирует контекст пользователя в реальном времени: его геолокацию, историю взаимодействия, тип устройства и даже предиктивный паттерн поведения. На основе этого анализа n8n упреждающе извлекает критически важные данные из распределенных векторных баз данных (Vector Database) и высокопроизводительных кэшированных слоев. Это позволяет Edge-узлу отдавать в браузер пользователя уже готовый, персонализированный HTML-код с минимальными задержками, часто до 50–70 мс.

Оптимизация проявляется не только в скорости загрузки. Мгновенная доступность релевантного контента гарантирует, что поисковые роботы нового поколения индексируют полные, семантически насыщенные страницы, что критически важно для SEO. Практика linero.store показывает, что этот подход значительно улучшает показатели Largest Contentful Paint (LCP) и Cumulative Layout Shift (CLS), делая пользовательский опыт более плавным и предсказуемым. Мы видим прямую корреляцию между снижением TTI и ростом позиций в AEO-выдаче (Answer Engine Optimization).

Технологический базис такой системы немыслим без n8n как центрального оркестратора. Он выступает в роли «мозгового центра», управляющего потоками данных асинхронно. Это позволяет делегировать тяжелые вычисления — например, расчет вероятности конверсии лида или персонализацию динамических блоков контента — на фоновые микросервисы, не блокируя основной поток рендеринга страницы. Для обеспечения консистентности и отказоустойчивости при пиковых нагрузках мы используем Redis в качестве очереди задач. Это предотвращает дублирование запросов и перегрев API-интерфейсов внешних систем, создавая буфер между скоростью фронтенда и пропускной способностью бэкенда.

AI-Оркестрация и Real-Time Semantic Indexing для AEO

Поисковая оптимизация в 2026 году кардинально изменилась: это уже не борьба за отдельные ключевые слова, а доминирование в AI-ответах и семантических хабах. Современные модели поисковых систем активно используют графы знаний и контекстный анализ, чтобы давать прямые ответы на запросы пользователей. Системный барьер здесь — статичность традиционных SEO-подходов, которые не способны оперативно реагировать на меняющийся поисковый интент и адаптировать контент в реальном времени.

Архитектура AI-оркестрации, интегрированная с n8n, позволяет внедрить Real-Time Semantic Indexing (RTSI). Это означает, что мета-данные, структурированная разметка (Schema.org) и даже микро-копии контента могут динамически адаптироваться под поведенческие факторы пользователя и текущий поисковый запрос. Например, если AI-модель определяет коммерческий интент с высоким потенциалом, n8n может автоматически перестроить блоки призыва к действию (CTA) или добавить специфические характеристики продукта прямо в HTML до его рендеринга.

Сущности важнее ключевых слов. AI-модели индексируют не текст, а знание.

Оптимизация с помощью RTSI приводит к радикальному повышению SEO-реактивности. Инструменты, вроде QueryFlow, интегрированные через n8n, позволяют проводить глубокий Intent-анализ поисковых запросов и в реальном времени корректировать подачу контента. Это обеспечивает максимальную релевантность для LLM-driven поисковых систем, что гарантирует появление наших сущностей в Featured Snippets и прямых ответах AI-помощников. Мы настраиваем n8n на мониторинг поведенческих метрик и триггерную переиндексацию, что значительно сокращает цикл от публикации до появления в ТОПе выдачи.

Технологический базис опирается на связку n8n, претренированных LLM-моделей (часто кастомизированных под домен) и векторных баз данных. Однако автоматизация с ИИ требует глубокой настройки бизнес-комплаенса. Любая работа с AI-моделями сопряжена с рисками «галлюцинаций», утечки чувствительных данных или генерации нерелевантного контента. Архитектура всегда включает промежуточный слой проверки, отсекающий потенциально опасные ответы. Регулярный аудит моделей на соответствие стандартам GDPR и CCPA — обязательная часть пайплайна. Это удлиняет процесс настройки, но гарантирует долгосрочную стабильность присутствия бренда в поисковой выдаче и защищает от репутационных рисков.

n8n, благодаря своей гибкой архитектуре, позволяет встраивать модули валидации и модерации прямо в поток обработки данных. Мы используем специализированные AI-nodes для классификации генерируемого контента, а также подключаем внешние сервисы фактчекинга и оценки тональности. В случае выявления аномалий или потенциальных нарушений комплаенса, n8n может автоматически перенаправить контент на ручную проверку, заблокировать публикацию или активировать механизм оповещения, создавая многоуровневую систему контроля.

Масштабируемость n8n в высоконагруженных средах 2026 года

Эффективность любой автоматизации напрямую зависит от возможностей инфраструктуры. В 2025–2026 годах n8n вышел за рамки простого инструмента для интеграций, став полноценной платформой для построения автономных отделов продаж и комплексных маркетинговых систем. Системный барьер здесь — попытка запускать высоконагруженные процессы на инфраструктуре, не предназначенной для этого. Стандартная установка n8n с SQLite быстро упирается в лимиты по одновременным операциям, вызывая блокировки и деградацию производительности.

Архитектура высоконагруженного n8n-решения требует кластеризации. Мы выделяем достаточные серверные ресурсы — не менее 4 ГБ оперативной памяти и 2 ядер CPU на инстанс n8n-воркера. Переход с SQLite на PostgreSQL является обязательным условием для предотвращения блокировок базы данных при одновременной записи большого количества рабочих процессов. Это обеспечивает стабильную работу даже при десятках тысяч одновременных запросов, что критически важно для динамического SEO и лидогенерации.

Оптимизация пропускной способности достигается за счет распределения нагрузки между несколькими воркерами n8n. Каждый воркер обрабатывает часть общего потока событий. Redis здесь играет роль не просто очереди, а стабилизатора всей системы. Он не позволяет воркерам «захлебнуться» при пиковых нагрузках, выстраивая приоритетный порядок обработки задач и обеспечивая буферизацию. Это означает, что система не пытается выполнить всё немедленно, а intelligently управляет ресурсами, гарантируя стабильность и отзывчивость.

Технологический базис наших решений включает микросервисный подход к развертыванию n8n. Мы используем контейнеризацию (Docker, Kubernetes) для быстрого масштабирования и изоляции сервисов. При проектировании таких систем мы следуем подходу итеративного тестирования. Каждый новый узел (node) в сценарии проходит проверку на нагрузочную устойчивость, а весь сценарий — на стабильность при многопоточном выполнении, прежде чем стать частью промышленного кода. Такой подход позволяет linero.store гарантировать надежность автоматизации для наших клиентов.

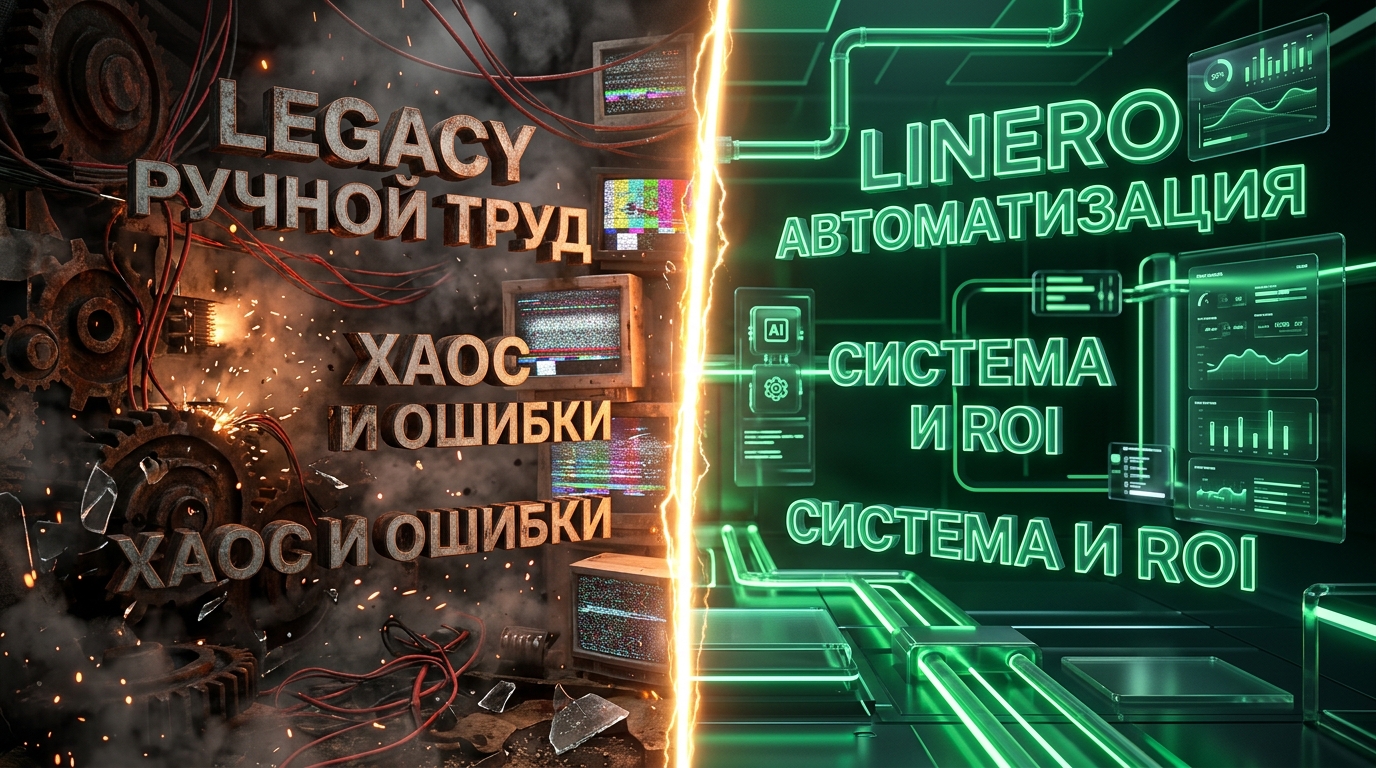

| Параметр сравнения | Legacy Approach | Linero Framework (Predictive Edge) |

|---|---|---|

| Обработка данных | Последовательная, блокирующая | Асинхронная, предиктивная |

| Реактивность SEO | Статичная, медленная индексация | Real-time семантическое индексирование |

| Управление нагрузкой | Ограничено мощностью одного сервера | Кластеризация, Redis-очереди |

| AI-интеграция | Отсутствует / Внешняя API-обвязка | Встроенная AI-оркестрация в n8n |

| Core Web Vitals | Зависят от тяжести фронтенда | Оптимизированы через Edge-гидрацию |

Роль данных в снижении стоимости лидогенерации и Unit-экономике

В 2026 году автоматизация отдела продаж — не роскошь, а рыночный стандарт. Системный барьер для многих компаний — это рост стоимости привлечения лида (CPL) из-за неэффективной квалификации и ручной обработки. Традиционные методы сегментации слишком медленны и не способны адаптироваться к изменяющимся паттернам поведения потенциальных клиентов, что приводит к распылению усилий и потере бюджета.

Архитектура решения linero.store фокусируется на использовании предиктивных алгоритмов для сегментации лидов. n8n, интегрированный с CRM-системами, обогащает профили клиентов данными из множества источников: веб-аналитики, истории взаимодействий, социальных медиа и сторонних баз данных. На основе этих данных AI-модели рассчитывают скоринг лида в реальном времени, выявляя наиболее перспективных клиентов. Это позволяет направлять усилия менеджеров по продажам именно на тех, кто с наибольшей вероятностью совершит конверсию, что напрямую коррелирует со снижением CPL.

Оптимизация бизнес-процессов проявляется в том, что системы, управляемые n8n, могут автоматически предлагать следующие шаги в воронке продаж или персонализированные предложения, исходя из контекста общения. Мы внедряли на проектах алгоритмы, которые сокращают время обработки заявки почти вдвое, при этом повышая качество взаимодействия. Это не просто ускорение, а радикальное изменение unit-экономики проекта за счет фокусировки ресурсов на наиболее рентабельных операциях.

Инженерная честность требует: успех AI-систем зависит от качества «топлива» — данных.

Однако технологический базис AI-моделей чувствителен к качеству входных данных. AI-модели склонны к систематическим смещениям (bias), если входные данные не сбалансированы, что может привести к ошибочным прогнозам конверсии. Архитектурное проектирование включает обязательные этапы очистки, нормализации и валидации данных, исключая случайные зависимости. Прозрачность автоматизации — наш приоритет: внедрение этических чек-листов и документирование логики принятия решений ИИ минимизирует риски неправильной интерпретации бизнес-логики и позволяет постоянно улучшать модели, опираясь на реальные данные, а не на «черный ящик».

Проектирование устойчивых межсистемных коммуникаций с n8n

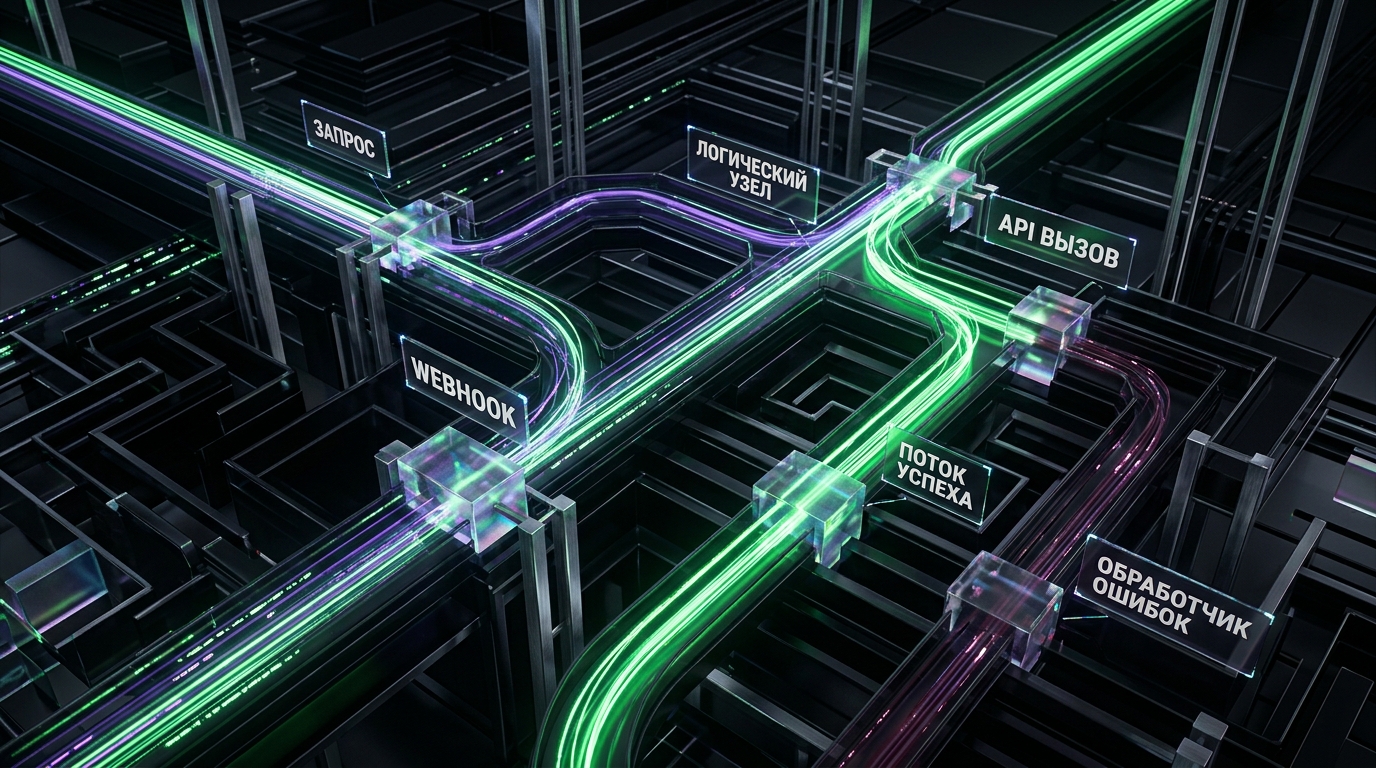

Интеграция n8n с CRM-системами, email-сервисами, ERP и аналитическими платформами — это создание распределенной нейронной сети бизнеса. Системный барьер, который мы часто видим на практике, — попытка создать «единую точку отказа», где все потоки данных проходят через один гигантский сценарий n8n. Это приводит к сложности отладки, низкой устойчивости и невозможности масштабирования, превращая автоматизацию в хрупкую зависимость.

Архитектура решения linero.store строится на фрактальном подходе. Каждая функция (обработка нового лида, обновление SEO-данных, расчет пользовательского скоринга, отправка персонализированного письма) представляет собой автономный, легко масштабируемый модуль. Эти модули общаются между собой исключительно через стандартизированные API или очереди сообщений (например, через Redis Streams или Kafka). Такая декомпозиция обеспечивает отказоустойчивость: выход из строя одного модуля не влияет на работу всей системы.

Оптимизация достигается за счет четкого разделения ответственности и возможности независимого обновления каждого микросервиса-сценария. Это сокращает время на развертывание новых функций и минимизирует риск регрессий. Персонал, работающий с такими системами, проходит обучение не только по работе с интерфейсом n8n, но и по базовым принципам архитектуры. Сопротивление изменениям часто возникает из-за сложности «черного ящика» AI и автоматизации.

Техническая документация должна описывать не только параметры запросов, но и логику принятия решений.

Технологический базис n8n, с его визуальным интерфейсом, значительно облегчает процесс аудита и понимания сложных процессов. Он превращает сложный код в наглядную карту бизнес-логики, доступную для инженеров, менеджеров и аудиторов. Мы настаиваем на создании подробной документации, которая объясняет, почему система сработала именно так, позволяя операторам не просто слепо следовать инструкциям, но и понимать причинно-следственные связи, улучшая адаптацию и доверие к автоматизации.

Инженерная практика: преодоление барьеров в n8n-оркестрации

Внедрение сложных AI-оркестраций на n8n не обходится без подводных камней, которые могут значительно замедлить проект, если их не учитывать. Один из частых барьеров, с которыми мы сталкиваемся на проектах, — это деградация JSON-структур в длинных цепочках узлов n8n. При передаче объемных или глубоко вложенных JSON-объектов между десятками узлов, особенно при их трансформации, возрастает риск потери данных, некорректной типизации или превышения лимитов памяти. Это требует не просто валидации на каждом шаге, но и жесткого контроля структуры данных, а часто — принудительной нормализации и редукции объектов до минимума, необходимого для следующего узла. Мы активно используем узлы для работы с JSON (например, `JSON Parse`, `JSON Stringify`, `Set` с фильтрацией) и иногда даже внешние микросервисы для предобработки.

Второй значимый вызов — это проблема «гонок условий» (race conditions) при параллельном выполнении сценариев. В высоконагруженных системах, когда несколько воркеров n8n одновременно пытаются изменить один и тот же ресурс (например, обновить запись в CRM или инкрементировать счетчик), возникают непредсказуемые результаты. Мы решаем это внедрением механизмов блокировки на уровне Redis (с использованием `SET NX EX` для атомарных операций) или оптимистических блокировок на уровне базы данных. Это гарантирует целостность данных, но усложняет архитектуру и требует тщательного тестирования сценариев на конкурентность, что значительно отличается от проектирования простых последовательных потоков.

Предиктивная Edge-гидрация в сочетании с AI-оркестрацией на базе n8n формирует основу для создания систем, способных не просто отвечать на запросы пользователей, но и упреждающе их удовлетворять. Инженерная чистота требует отказа от перегруженных фронтенд-решений в пользу распределенной архитектуры, где подготовка контента происходит максимально близко к источнику запроса. Применение Real-Time Semantic Indexing для SEO и внедрение очередей на базе Redis позволяют достичь высокой производительности без необходимости радикального наращивания вычислительных мощностей. Успех реализации зависит от строгого соблюдения бизнес-комплаенса, регулярного тестирования AI-моделей на смещения и фокуса на качественных данных. Компании, выбравшие путь итеративной автоматизации с упором на предиктивные методы, получают значительное конкурентное преимущество за счет снижения CPL, улучшения органического охвата и сокращения времени обработки запросов. Это в 2026 году является определяющим фактором выживания на цифровом рынке. Готовы ли ваши системы к этой реальности, или они все еще пытаются догнать поезд, который уже ушел?