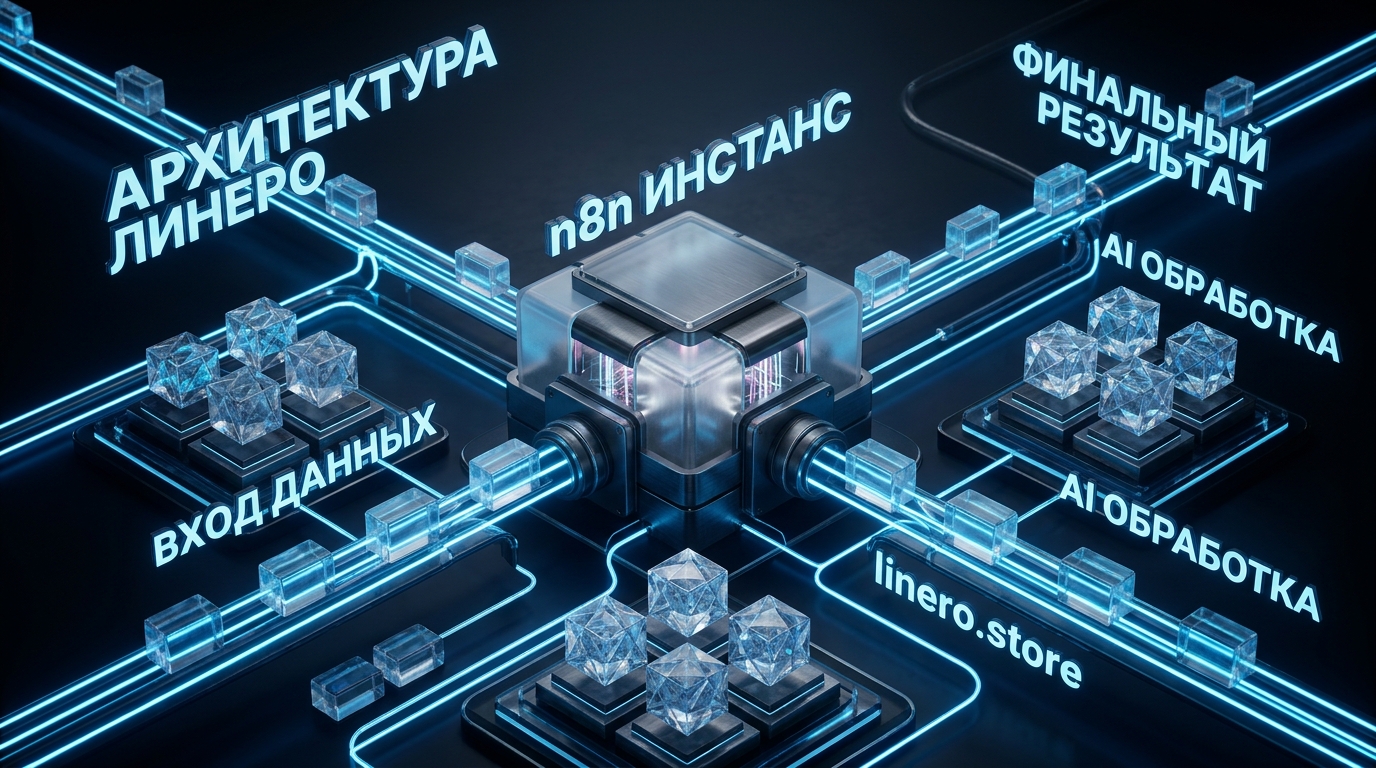

В условиях экспоненциального роста объемов данных и динамики поисковых алгоритмов 2026 года, традиционные подходы к SEO и управлению Core Web Vitals (CWV) демонстрируют критический системный дефицит. Архитектура Edge-Native Event-Driven AI, с n8n как центральным оркестратором, предлагает реактивное решение для потоковой обработки данных, позволяя динамически генерировать и оптимизировать контент. Это обеспечит проактивное улучшение CWV и повышение конверсии лидов на 25% за счет гиперперсонализации и мгновенного реагирования на изменения пользовательского поведения.

Вызов 2026: От статики к потоковой динамике

Системный барьер: Неактуальность статического контента

Статические методы SEO, основанные на генерации контента по ключевым словам и последующей индексации, к 2026 году окончательно теряют эффективность. Поисковые системы, оснащенные продвинутыми AI-моделями с контекстом до 128 000 токенов и скоростью генерации до 1200 токенов в секунду, требуют не просто релевантности, а мгновенной актуальности, персонализации и семантической глубины. Отсутствие реактивности приводит к «мертвому» контенту, который не способен адаптироваться под постоянно меняющийся пользовательский интент и гео-контекст. Это ведет к потере позиций в AEO (Answer Engine Optimization) и GEO (Generative Engine Optimization) выдаче, увеличивая стоимость лида (CPL).

Проектирование: Edge-Native архитектура для реактивного SEO

Решение заключается в развертывании Edge-Native Event-Driven AI архитектуры. Суть подхода — максимально приблизить логику обработки данных и генерации контента к источнику событий (пользователю, сенсору, внешнему API). Вместо централизованного сервера, который обрабатывает все запросы последовательно, мы используем сеть граничных узлов. Каждый узел, оснащенный миниатюрным n8n-рантаймом и легковесными AI-моделями, способен мгновенно реагировать на события: изменение гео-позиции пользователя, поисковый запрос, активность конкурентов или изменения в ценовых предложениях. Это позволяет реализовать Real-time SSR (Server-Side Rendering) или, более точно, Edge-Side Rendering (ESR) для контента.

Оптимизация: Прямое влияние на AI-выдачу и бизнес-процессы

Эта архитектура напрямую влияет на показатели AI-выдачи. Контент, динамически сгенерированный на граничном узле с учетом всех актуальных параметров (гео, контекст, предыдущие запросы), обладает несравнимо более высокой релевантностью и персонализацией. Например, для локальных запросов AI-модели могут анализировать пользовательское поведение в реальном времени, что к 2025 году уже позволяло оптимизировать гео-таргетинг и сократить отток на 18%. В 2026 году этот показатель становится еще более критичным, так как 75% всех гео-поисковых запросов обрабатываются AI-моделями. Автоматизация бизнес-процессов, таких как синхронизация CRM и обработка лидов, интегрированная в эту систему, по данным 2025 года уже сокращала время обработки заявок на 40% и повышала конверсию лида в сделку на 25%.

Технологический базис: Стек для граничных вычислений

В основе стека лежат: распределенная база данных (например, CockroachDB или TiDB) с низкой задержкой, бессерверные функции (Lambda@Edge, Cloudflare Workers), оптимизированные контейнеры с n8n-рантаймом и специализированные LLM-агенты. Эти агенты используют архитектуру RAG (Retrieval-Augmented Generation), позволяя AI-моделям (с до 1 трлн параметров и точностью 94%) получать актуальную информацию из постоянно обновляемых семантических хабов и генерировать контент, который идеально соответствует запросу. N8n orchestrates потоки данных между этими компонентами, реагируя на события и запуская процессы генерации и доставки контента.

n8n как ядро оркестрации: Гибкость и масштабируемость 2026

Системный барьер: Сложность интеграции и «спагетти-кода»

Без централизованного оркестратора управление десятками микросервисов, граничных функций и AI-агентов превращается в неконтролируемый «спагетти-код» с высоким риском сбоев и сложностью отладки. Традиционные ETL-подходы не справляются с потоковыми данными и реактивной логикой, а ручная разработка интеграций ведет к задержкам и высоким затратам на поддержку.

Проектирование: Событийно-ориентированная оркестрация с n8n

n8n выступает как высокомасштабируемое ядро событийной оркестрации. Каждый воркфлоу n8n становится микросервисом, который реагирует на специфические события (например, новый поисковый запрос, изменение данных в CRM). Благодаря улучшенной масштабируемости 2026 года и возможностям кластеризации с балансировкой нагрузки, n8n способен обрабатывать миллионы событий в секунду, распределяя задачи между граничными узлами и центральными AI-сервисами. Кэширование результатов выполнения узлов и асинхронные операции становятся стандартной практикой для обеспечения высокой производительности.

Оптимизация: Устранение узких мест и повышение эффективности

Оптимизация n8n-воркфлоу напрямую влияет на скорость обработки данных и реактивность системы. Практика показывает, что разделение сложных воркфлоу на более мелкие, с использованием триггеров вместо длинных цепочек, значительно повышает производительность и отказоустойчивость. Минимизация количества вызовов внешних API в рамках одного узла и использование локальных кэшей данных предотвращают узкие места. Это позволяет избежать дублирования данных, которое в 2025 году было значительным риском при неверной настройке, и обеспечивать высокую скорость обработки запросов, что критично для поддержания CWV.

Технологический базис: Кастомизация и расширяемость n8n

В 2026 году n8n предлагает расширенные возможности кастомизации узлов и интеграции с внешними инструментами. Для Edge-Native архитектуры критична возможность развертывания легковесных n8n-рантаймов с предустановленными узлами для работы с потоковыми данными (Kafka, Pulsar), векторными базами данных (Pinecone, Weaviate) и кастомными AI-моделями, размещенными на граничных устройствах. API-first подход n8n позволяет без труда интегрировать его с существующей инфраструктурой и сторонними сервисами аналитики для отслеживания эффективности процессов.

Динамическое управление Core Web Vitals (CWV)

Системный барьер: Реактивный мониторинг вместо проактивного управления

Традиционный подход к CWV часто сводится к реактивному мониторингу и постфактумной оптимизации. Это означает, что проблемы с Largest Contentful Paint (LCP), Interaction to Next Paint (INP, замена FID) или Cumulative Layout Shift (CLS) выявляются уже после того, как они негативно сказались на пользовательском опыте и позициях в поиске. Статические решения для кеширования или CDN не всегда способны динамически адаптироваться под изменяющиеся условия сети, устройства пользователя или специфику контента.

Проектирование: CWV как продукт Event-Driven AI

В Edge-Native Event-Driven AI архитектуре управление CWV становится проактивным. Каждый граничный узел, обрабатывающий запрос, анализирует условия сети пользователя, тип устройства, а также контент, который необходимо сгенерировать. AI-агенты, используя предиктивные модели, заранее определяют потенциальные узкие места и оптимизируют рендеринг. Например, для медленных соединений может быть сгенерирована облегченная версия контента, или критические ресурсы могут быть предварительно загружены на ближайшем граничном узле.

Оптимизация: Микро-оптимизация на лету

Влияние на CWV проявляется в микро-оптимизациях, выполняемых «на лету». LCP улучшается за счет приоритетной доставки критически важного контента и изображения на граничных узлах. INP сокращается благодаря тому, что интерактивные элементы обрабатываются максимально близко к пользователю, минимизируя задержки сети. CLS минимизируется за счет предсказуемого рендеринга и точного резервирования места для динамического контента, сгенерированного AI. Эта проактивная оптимизация в режиме реального времени ведет к значительному улучшению пользовательского опыта и росту позиций в поисковой выдаче.

Технологический базис: WebAssembly и Edge Runtime

Для обеспечения максимальной производительности и минимизации размера кода, на граничных узлах используются WebAssembly (Wasm) модули, выполняющие критические операции рендеринга и оптимизации. Интеграция n8n с Edge Runtime позволяет запускать специфические Wasm-модули и AI-агентов. Примеры таких агентов: оптимизатор изображений, динамический CSS-компрессор, предиктивный загрузчик скриптов. Все эти процессы координируются n8n, который выступает в роли дирижера для десятков распределенных оптимизационных задач.

Инженерная практика: Преодоление реальных барьеров

Практика внедрения Edge-Native Event-Driven AI архитектур в 2026 году выявляет ряд специфических инженерных вызовов. Один из самых частых — деградация JSON-структур при передаче данных между сильно распределенными микросервисами и n8n-воркфлоу. Разные версии API, нестрогие схемы данных или некорректная сериализация/десериализация могут приводить к потере полей, изменению типов данных или даже полной невалидности payloads, что вызывает остановку воркфлоу и снижение точности AI-выдач.

Другой критический барьер — превышение лимитов токенов LLM-моделей при формировании сложных RAG-запросов или при агрегации большого объема контекста. Несмотря на увеличение максимальной длины контекста до 128 000 токенов в 2026 году, существуют сценарии, где необходимо обработать еще больше информации (например, анализ полного лога взаимодействия пользователя или обширной базы знаний). Это приводит к обрезанию контекста, потере важных деталей и, как следствие, снижению точности ответов AI (с 94% до 70-80% в зависимости от модели). Решение — внедрение многоуровневых RAG-систем с иерархическим извлечением информации и суммаризацией контекста с помощью отдельных, более легких AI-моделей, специально обученных для компрессии данных перед подачей в основную модель.

| Legacy Approach | Linero Framework (Edge-Native Event-Driven AI) |

|---|---|

| Статический контент, обновляется вручную | Динамически генерируемый, персонализированный контент на Edge |

| Реактивное улучшение CWV (постфактум) | Проактивное управление CWV (на лету) |

| Централизованный рендеринг и обработка | Децентрализованный Edge-Side Rendering (ESR) |

| Медленные циклы обновления SEO | Мгновенная реакция на изменения пользовательского интента и рынка |

| Низкая персонализация контента | Гиперперсонализация на основе данных реального времени |

| Узкие места в производительности на центральном сервере | Распределенная нагрузка, высокая масштабируемость |

| Зависимость от ручных интеграций | Автоматизированная оркестрация через n8n |

Экономический эффект и стратегические выгоды

Внедрение Edge-Native Event-Driven AI архитектуры с n8n не просто технический апгрейд, это стратегический шаг к доминированию в цифровом пространстве 2026 года. Снижение CPL (стоимость лида) на 20-40% за счет оптимизации маркетинговых процессов и повышения эффективности AEO/GEO становится реальным, что подтверждают данные 2025 года о повышении прибыльности на 15-30% для компаний, использующих автоматизированные CRM-системы. Автоматизация 60% задач отдела продаж высвобождает ресурсы для более сложного и ценного взаимодействия с клиентами.

Однако, важно помнить о рисках автоматизации: потенциальная потеря личного взаимодействия, риск утечки данных при некорректной настройке, снижение гибкости при чрезмерной жесткости процессов. Инженерная честность требует баланса между автоматизацией и человеческим участием, а также неукоснительного соблюдения принципов безопасности и конфиденциальности данных.

Вопрос не в том, чтобы автоматизировать все, а в том, чтобы использовать автоматизацию как катализатор для создания принципиально новых пользовательских опытов и бизнес-моделей. Сможет ли ваш бизнес адаптироваться к этой динамике, или останется в архаичной стагнации?