Современный B2B-ландшафт страдает от низкой адаптивности AI-агентов, приводящей к провалам в обработке неструктурированных данных и отсутствию рыночного соответствия, как это наблюдалось в 2025 году. Решение кроется в Edge-Native Reinforcement Learning и автономной оркестровке на n8n 2026 года, позволяющей AI-агентам непрерывно адаптироваться к изменяющимся условиям. Это гарантирует гиперперсонализированный UX и проактивное доминирование в SEO, трансформируя конверсию и удержание клиентов.

Кризис адаптивности AI-Агентов: Уроки 2025 года

Системный барьер, с которым столкнулась индустрия в 2025 году, заключался в фундаментальном недостатке гибкости большинства AI-агентов. Практика показала, что отсутствие адаптации к реальным условиям рынка стало основной причиной их провалов. Агенты не справлялись с некорректной обработкой неструктурированных данных, их обученность на специфических задачах была недостаточной, а отсутствие обратной связи от пользователей приводило к стагнации. AI-агенты часто не могли выполнить задачи, требующие творческого мышления или эмоционального интеллекта, снижая эффективность автоматизированных процессов.

Проектирование решения требует отхода от статических, централизованных моделей. Мы проектируем адаптивные системы, способные к непрерывному самообучению и корректировке стратегий на основе потоковых данных. Это не просто обновление модели, а фундаментальный сдвиг к архитектуре, где каждый агент обладает определённой степенью автономности и возможностью адаптироваться в режиме реального времени.

Оптимизация влияния на AI-выдачу и бизнес-процессы достигается за счёт минимизации задержек и повышения релевантности взаимодействий. Когда агент может мгновенно реагировать на новые данные или изменения в поведении пользователя, качество гиперперсонализации и точность проактивных действий возрастают многократно. Это напрямую влияет на конверсию и удержание.

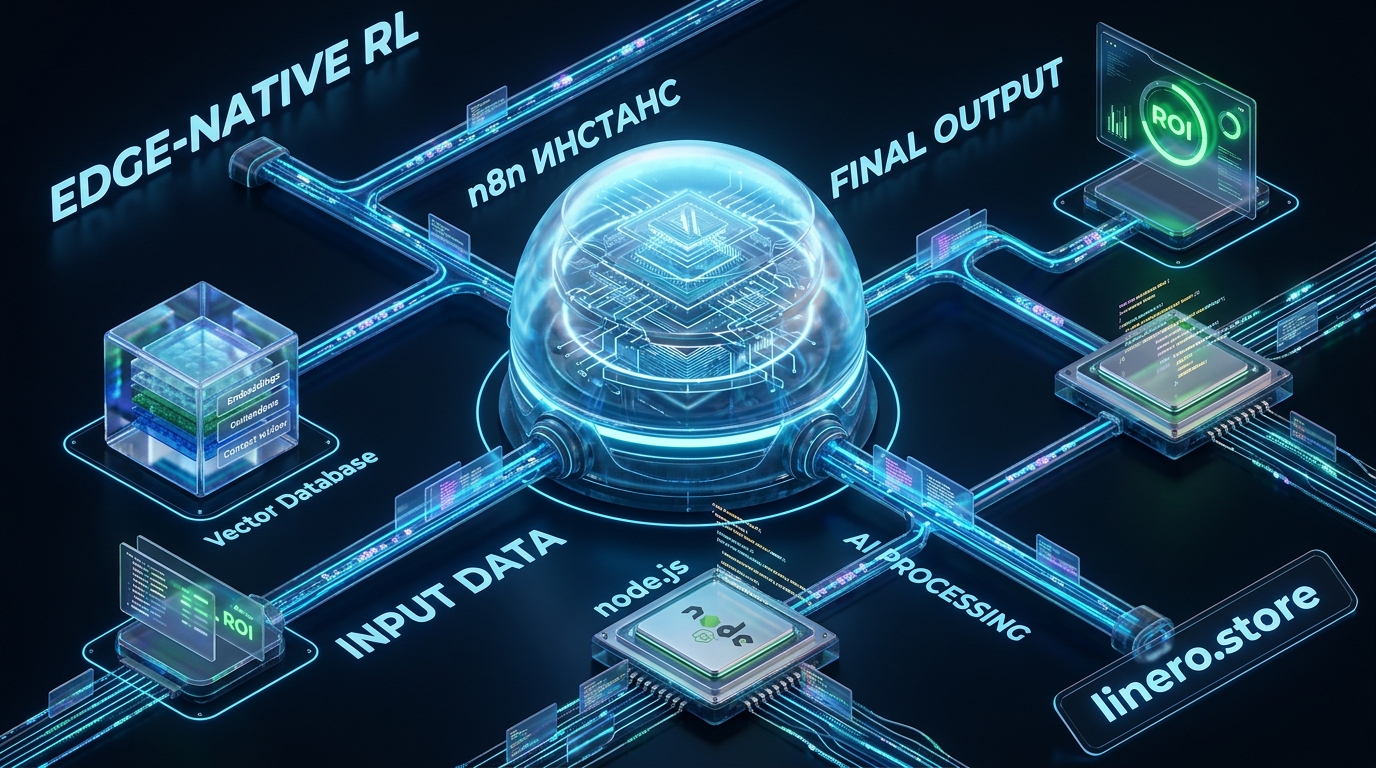

Технологический базис для таких систем включает Edge Computing для локальной обработки данных и принятия решений, а также Reinforcement Learning (RL) для обучения адаптивному поведению. В качестве оркестратора, связывающего эти децентрализованные компоненты и управляющего потоками данных и обратной связи, мы используем n8n, способный интегрировать разнообразные модели и источники данных.

Edge-Native Reinforcement Learning: Автономная Оркестровка с n8n

Системный барьер традиционных облачных ML-архитектур — это латентность и затраты на передачу данных. Для гиперперсонализированного UX и проактивного SEO доминирования требуется мгновенная реакция. Централизованные модели не успевают обрабатывать и адаптироваться к постоянно меняющимся паттернам поведения на периферии сети.

Проектирование Edge-Native Reinforcement Learning подразумевает развёртывание AI-агентов непосредственно на граничных устройствах или в ближайших к пользователю точках сети. Эти агенты обучаются на локальных данных, используя RL-подходы, что позволяет им адаптироваться к уникальным контекстам каждого пользователя. n8n выступает как центральный хаб оркестровки, связывающий эти автономные агенты с центральными хранилищами данных, моделями обновления и бизнес-логикой. n8n не только распределяет задачи и собирает обратную связь, но и триггерит обновление локальных моделей на основе глобальных инсайтов.

Оптимизация проявляется в сокращении времени отклика и повышении релевантности рекомендаций или контента. Каждый Edge-Native агент действует как высокоспециализированный эксперт для своего сегмента или даже отдельного пользователя, что увеличивает точность прогнозов и качество взаимодействия. Бизнес-процессы становятся по-настоящему проактивными, а не реактивными.

Технологический базис включает легковесные контейнеризованные RL-модели, развёрнутые на Edge-серверах (например, через K3s или AWS IoT Greengrass) и взаимодействующие с n8n через высокоскоростные API или WebSockets. n8n 2026 года обеспечивает лимиты до 1000 активных workflow и пиковую пропускную способность до 5000 запросов в минуту, что критично для масштабирования такой архитектуры.

Гиперперсонализированный UX в B2B: От Сегментации к Сущностям

Системный барьер: В 2026 году общая персонализация B2B, основанная на крупных сегментах, уже неэффективна. Клиенты ожидают уникального опыта, основанного на их индивидуальных потребностях, поведении и даже невербальных сигналах. Старые методы приводят к низкой конверсии и высокому оттоку.

Проектирование гиперперсонализированного UX подразумевает создание динамического профиля каждого клиента, обновляемого в реальном времени. RL-агенты на базе Edge-Native архитектуры анализируют каждое взаимодействие (клики, прокрутки, время на странице, запросы к AI-помощникам) и адаптируют контент, предложения, последовательности писем и даже интерфейс под конкретного пользователя. n8n здесь оркестрирует сбор этих данных из различных источников (CRM, CDP, веб-аналитика, LLM-чаты) и триггерит изменения в контент-системах или внешних API.

Оптимизация: Практика показывает, что гиперперсонализация на уровне сущностей кардинально улучшает метрики. В B2B-маркетинге использование AI для персонализации коммуникации с клиентами на основе их отрасли, роли и поведения в воронке, увеличило отклик на кампании на 48%. В SaaS-индустрии гиперперсонализированные email-рассылки, основанные на поведенческом анализе пользователей, повысили CTR на 52% и сократили отток на 21%. Банк, внедривший AI-драйвенные рекомендации по продуктам в мобильном приложении, достиг увеличения числа активных пользователей на 41% и роста дохода от кросс-продаж на 29%.

Технологический базис: Для этого используются мощные векторные базы данных для хранения сущностных профилей, LLM-агенты для генерации персонализированного контента и n8n для интеграции всех этих компонентов. n8n способен обрабатывать потоковые данные от Edge-агентов, обновлять профили клиентов и мгновенно запускать персонализированные действия – от изменения цены до адаптации заголовка на целевой странице.

Как предотвратить информационный перегруз при гиперперсонализации?

Предотвращение информационного перегруза — ключевой аспект. Наши RL-агенты обучаются не только тому, что предложить, но и когда остановиться, а также как представить информацию в максимально лаконичной и релевантной форме. n8n позволяет создавать ‘правила безопасности’ (guardrails) для AI-агентов, ограничивая частоту и объём коммуникаций, а также применяя A/B-тестирование для определения оптимального порога персонализации.

Проактивное SEO-Доминирование 2026: От KeyWording к AEO (Answer Engine Optimization)

Системный барьер: Классическое SEO 2025 года, основанное на плотности ключевых слов и обратных ссылках, уже не даёт устойчивого преимущества. Поисковые системы, всё больше ориентированные на AI-ответы, требуют глубокого понимания сущностей, намерений пользователей и контекста. Конкуренция за «нулевую позицию» (AI-генерируемый ответ) становится критической.

Проектирование проактивного SEO-доминирования сосредоточено на AEO (Answer Engine Optimization) и GEO (Generative Engine Optimization). Это означает создание контента, который не просто содержит ключевые слова, а напрямую отвечает на сложные запросы пользователей, предвосхищает их потребности и формирует семантические хабы вокруг ключевых сущностей бизнеса. RL-агенты непрерывно анализируют SERP, поведение пользователей, новые запросы и изменения в алгоритмах поисковых систем, генерируя гипотезы для нового контента или оптимизации существующего.

Оптимизация: Позволяет компании стать не просто источником информации, а авторитетным «ответом» в глазах AI-поисковиков. Это обеспечивает присутствие на самых верхних позициях выдачи и формирует прочный фундамент для лидогенерации. Проактивный подход снижает риски, связанные с AI-оптимизированными стратегиями AEO, поскольку контент создаётся с учётом этических стандартов и нормативных требований.

Технологический базис: n8n здесь является оркестратором всей цепочки: от мониторинга поисковой выдачи и анализа конкурентов, через LLM-стек для генерации и кластеризации контента (основанного на RAG-архитектурах), до публикации и последующего анализа эффективности. n8n может триггерить перегенерацию контента, если RL-агент выявит изменение в пользовательских запросах или предпочтениях AI-поисковиков.

Legacy Approach vs Linero Framework

| Критерий | Legacy Approach (2025) | Linero Framework (2026) |

|---|---|---|

| Философия AI | Централизованные, статические модели | Децентрализованные, адаптивные Edge-Native RL-агенты |

| Архитектура | Монолитные облачные ML-системы | Гибридная Edge/Cloud с автономными агентами и n8n-оркестровкой |

| Персонализация | Сегментация на основе демографии/поведения | Гиперперсонализация на уровне сущностей, real-time адаптация UX |

| SEO/AEO | Реактивное keyword-SEO | Проактивное AEO/GEO на основе RL-агентов, сущностный контент, AI-driven ответы |

| Скорость адаптации | Месяцы (переобучение моделей) | Миллисекунды (Edge-адаптация, n8n-триггеры) |

| Обработка данных | Центр => Облако => Модель | Edge => n8n (оркестровка) => Модель (обучение) => Edge (принятие решений) |

| Масштабируемость | Вертикальная, дорогостоящая | Горизонтальная, через децентрализованные Edge-агенты, управляемые n8n |

| Устойчивость к сбоям | Высокая зависимость от центрального узла | Распределённая, высокая отказоустойчивость Edge-нодов, n8n-failover для оркестровки |

| ROI автоматизации | Нерелевантен из-за отсутствия адаптации (анализ 2025) | Потенциал для кратного роста за счет гиперперсонализации и проактивного доминирования |

Инженерная практика: Реальные вызовы и их решение

В инженерной практике внедрения Edge-Native Reinforcement Learning мы сталкиваемся с рядом критических проблем, которые требуют прагматичного подхода.

1. Превышение лимитов API n8n Insights и оптимизация: В 2026 году n8n значительно расширяет свои возможности, предлагая до 1000 одновременных активных workflow и пиковую пропускную способность API в 5000 запросов в минуту для бизнес-подписки. Однако, при интеграции тысяч Edge-Native агентов, генерирующих постоянный поток данных для центральной оркестровки и обучения, эти лимиты могут быть быстро исчерпаны. Стоимость превышения лимитов в $0.02 за каждый дополнительный запрос ощутима. Решение: Мы активно используем батчевые операции. Вместо того чтобы каждый Edge-агент отправлял одиночные запросы о своём состоянии или новых данных, мы агрегируем их и отправляем пачками. Для этого на Edge-нодах разворачиваются легковесные брокеры сообщений (например, Mosquitto MQTT), которые собирают данные и отправляют их в n8n с определённой периодичностью или при достижении заданного объёма. Кэширование данных в n8n Insights также помогает снизить нагрузку. Мы также настраиваем встроенные отчёты Insights и оповещения о приближении к лимиту, что позволяет оперативно реагировать, масштабируя подписку или оптимизируя логику.

2. Деградация JSON-структур при передаче:

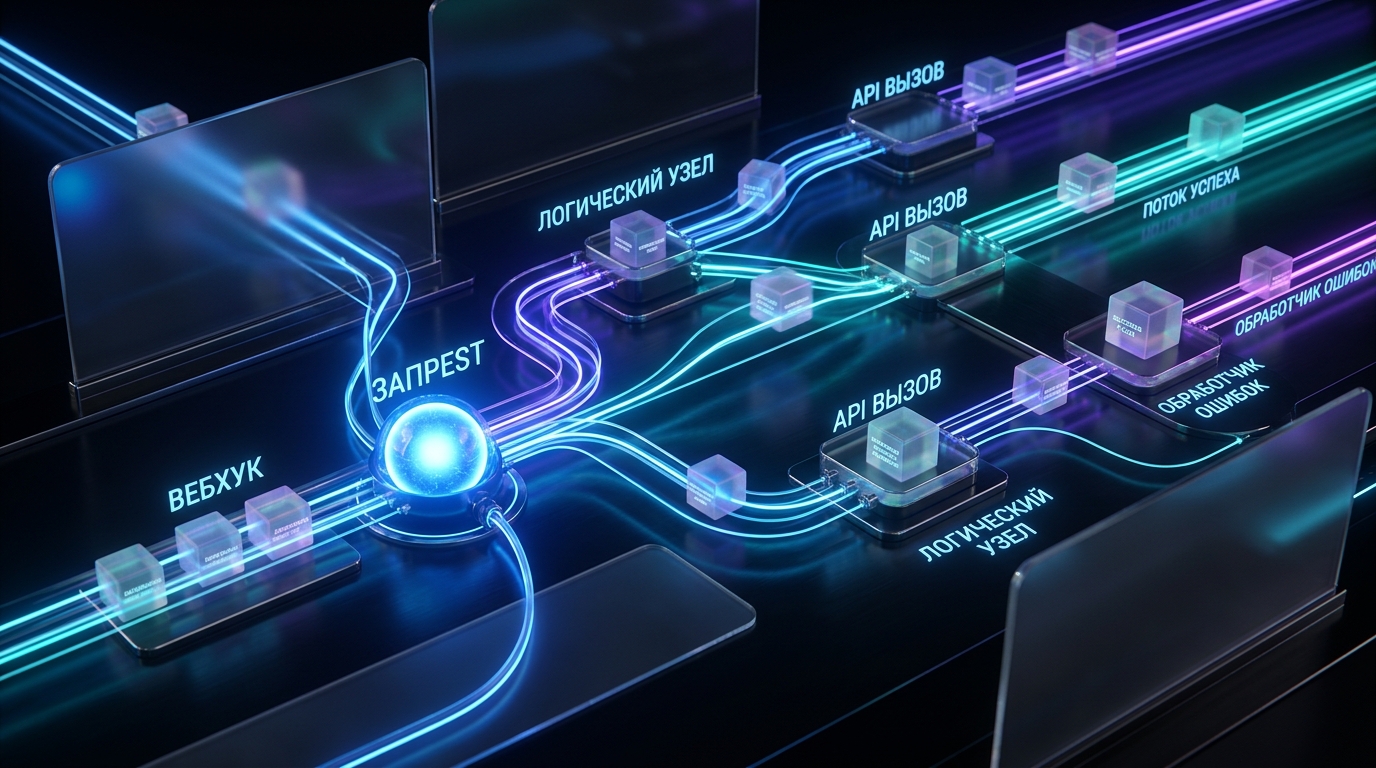

При передаче данных между различными Edge-нодами, центральными сервисами и n8n, особенно через HTTP-запросы, часто возникают проблемы с деградацией или некорректным парсингом сложных JSON-структур. Разные версии библиотек, нестрогая типизация или банальные ошибки в коде могут приводить к потере вложенности, изменению типов данных (числа в строки) или появлению лишних экранирующих символов. Решение: Строгая схема валидации данных (например, JSON Schema) на каждом этапе передачи. Каждый входящий в n8n вебхук проходит через ноду «JSON Schema Validate», которая проверяет структуру и типы данных. Перед отправкой из n8n или с Edge-ноды, данные также приводятся к строгому формату. Используем GraphQL для запросов, чтобы получать только необходимые поля и избегать избыточности, минимизируя потенциал ошибок.

3. Отвалы вебхуков и таймауты API:

Распределённые системы по своей природе подвержены нестабильности сети и таймаутам. Edge-агенты могут работать в условиях ограниченной или нестабильной связи, что приводит к недоставке вебхуков или таймаутам при обращении к внешним API через n8n. Решение: Реализация паттернов «Circuit Breaker» и «Retry with Exponential Backoff» как на стороне Edge-агентов, так и внутри n8n-workflow. Для вебхуков используем Durable Webhooks, которые гарантируют доставку даже при временной недоступности получателя. В n8n-workflow настраиваем ноды таким образом, чтобы они автоматически повторяли запросы с увеличивающимся интервалом при ошибках. Также критично использование механизмов идемпотентности, чтобы повторный запрос не приводил к дублированию действий.

Эти вызовы — не барьеры, а точки роста для повышения надёжности и эффективности всей системы.

В 2026 году доминировать будет не тот, кто просто внедряет AI, а тот, кто научился оркестрировать адаптивный интеллект на периферии, превращая каждый пиксель взаимодействия в точку проактивного роста. Вопрос лишь в том, готовы ли мы к такой скорости изменений и уровню сложности?