Корпоративные данные часто остаются фрагментированными, а традиционные системы продаж сталкиваются с деградацией эффективности, не отвечая запросам рынка 2026 года. Решение лежит в Headless Content Orchestration — архитектуре, где n8n и векторные базы данных трансформируют хаотичные потоки информации в гиперконтекстуальную персонализацию. Это обеспечивает доминирование в поисковой выдаче для AI-агентов и радикально снижает операционные издержки бизнеса.

Headless Content Orchestration: Деконструкция корпоративных данных

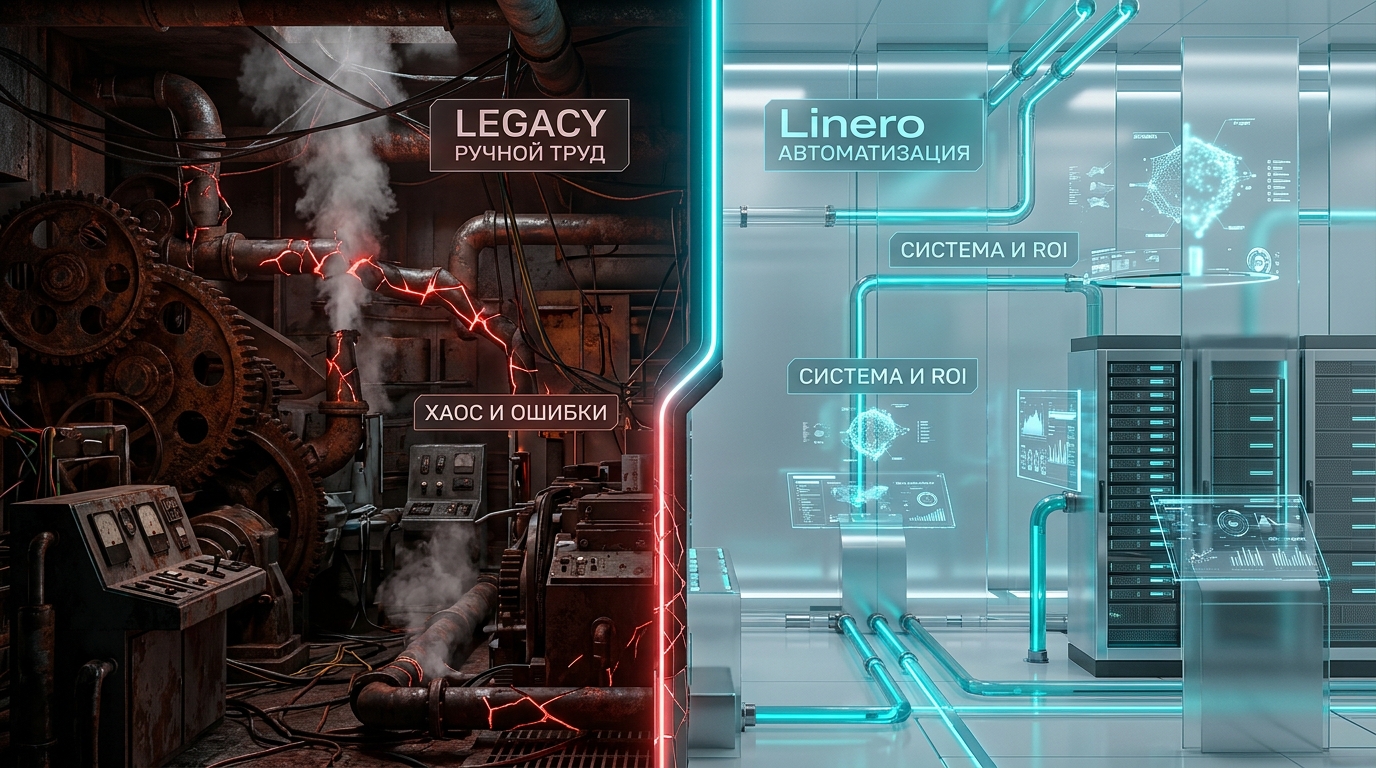

Традиционные системы управления данными страдают от монолитности и линейности процессов, где информация хранится в разрозненных, несемантических хранилищах. Этот системный барьер приводит к тому, что для сборки контекста, необходимого для персонализированного взаимодействия, требуются значительные ручные усилия. Как следствие, бизнес теряет в адаптивности и сталкивается с высокими транзакционными издержками, проигрывая конкурентам, которые уже перешли на более гибкие модели.

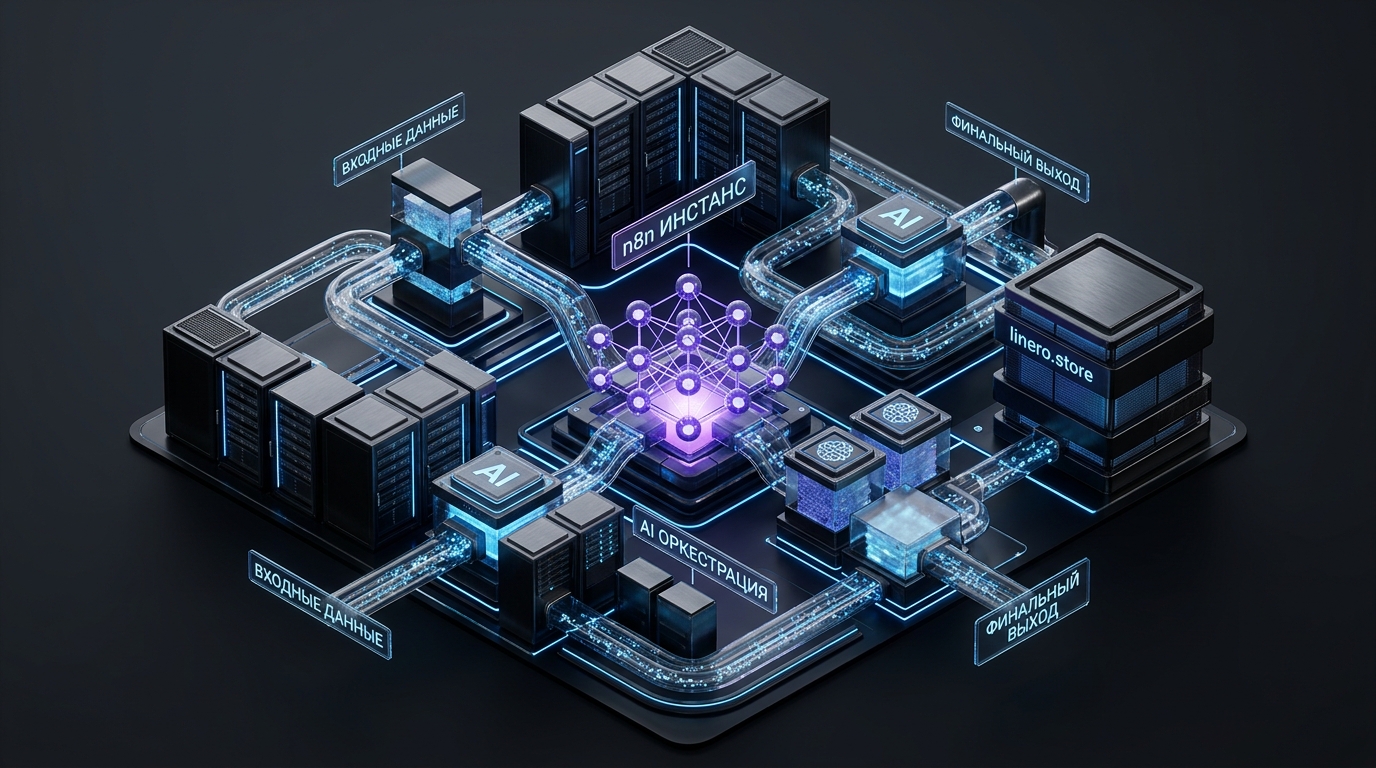

Архитектура Headless Content Orchestration переосмысливает принцип работы с данными, отделяя уровень их хранения и обработки от уровня представления.

В этой парадигме n8n выступает центральным оркестратором, динамически соединяющим разнообразные источники данных — от внутренних CRM и ERP до внешних API и специализированных баз знаний. В основе лежит создание Knowledge Graph, где каждая сущность (будь то продукт, клиент, конкурент или рыночный тренд) не просто хранится, но и обладает семантическими связями с другими сущностями. Это трансформирует статичную базу данных в живую, самообновляющуюся экосистему знаний.

Такой подход обеспечивает гиперконтекстуальную персонализацию. Вместо шаблонных ответов и предложений, AI-агенты, работая на Edge-инфраструктуре, получают обогащенный и релевантный контекст прямо у источника запроса. Это минимизирует задержки (latency), снижает нагрузку на центральные вычислительные мощности и, что критически важно, повышает качество ответа и его релевантность до беспрецедентного уровня. Для бизнеса это означает прямое сокращение цикла сделки, повышение конверсии и укрепление позиций в AI-выдаче.

Технологический базис решения включает n8n для построения гибких, событийно-ориентированных пайплайнов; векторные базы данных (например, Qdrant, Milvus, Pinecone) для семантического поиска по массивам неструктурированных данных; и специализированные LLM (такие как Llama 3.1, Gemini Pro 1.5 с контекстными окнами до 1М токенов) для генерации ответов. Edge-вычисления, реализуемые на платформах вроде Cloudflare Workers AI или граничных узлах Kubernetes, позволяют обрабатывать данные максимально близко к пользователю, обеспечивая моментальный отклик.

Анатомия провала: Почему автоматизация продаж часто терпит неудачу

Современная экосистема корпоративных продаж демонстрирует системную фрагментарность. Аналитика 2026 года показывает, что значительный процент компаний сталкивается с деградацией эффективности, потому что их архитектура не адаптирована под динамичные изменения рынка. Системы работают в режиме «нейро-голодания», перегружаясь неструктурированными данными, что замедляет процессы принятия решений.

Основная ошибка заключается в попытке наложить автоматизацию на хаотичные процессы, вместо трансформации самих процессов через инженерный подход. Нейросетевые модели, работающие на «грязных» или устаревших данных, генерируют неточные прогнозы, что подрывает доверие персонала и снижает принятие технологий на уровне конечных пользователей. Операционные издержки могут возрастать на 20–30% в период адаптации, а интеграция с legacy-системами часто поглощает до трети бюджета проекта без должной отдачи.

Инженерная парадигма оркестрации через n8n

n8n не просто автоматизирует; он оркестрирует. Платформа выступает в роли связующего звена, обеспечивая динамическую маршрутизацию данных между CRM, внешними базами знаний и LLM-стеком. В отличие от жестких, монолитных SaaS-решений, n8n позволяет выстраивать фрактально-глубокие пайплайны, способные к быстрой перенастройке без участия разработчика. Это критически важно в условиях меняющихся бизнес-требований.

На уровне архитектуры n8n-пайплайн начинается с векторизации и индексации всех корпоративных данных в специализированное Vector Database. В момент пользовательского запроса происходит семантический поиск, а n8n обогащает контекст через Retrieval-Augmented Generation (RAG) актуальной, верифицированной информацией. Этот механизм исключает «галлюцинации» модели, так как контент генерируется строго на основе проверяемой базы знаний компании. Интеграция с Edge-инфраструктурой дополнительно минимизирует задержки, повышая устойчивость системы при пиковых нагрузках.

Использование механизмов динамической маршрутизации и раннего выхода из слоев нейросетевых архитектур в наших проектах позволило сократить время выполнения задач на 30–70%, одновременно снижая нагрузку на вычислительные мощности. Это не просто экономия ресурсов, а возможность предоставлять мгновенный, релевантный ответ в критически важных точках взаимодействия с клиентом.

Инженерная практика: Преодоление барьеров в автономной оркестрации

Внедрение автономных AI-систем с n8n не лишено специфических инженерных вызовов. Мы в Linero.store постоянно сталкиваемся с необходимостью проработки деталей, которые напрямую влияют на стабильность и производительность системы.

Одним из частых барьеров являются таймауты внешних API. При построении сложных цепочек из десятков HTTP-запросов и взаимодействий с LLM, вероятность получения 504 ошибки возрастает экспоненциально. Наша практика показывает, что необходимы кастомные механизмы повторных попыток (retry logic) с экспоненциальной задержкой, а также полноценные «circuit breakers» в n8n для изоляции сбойных сервисов. Иначе вся цепочка оркестрации может «упасть» из-за временной недоступности одного компонента.

Другой критический аспект – это управление токенами и контекстными окнами LLM. Длинные цепочки данных, передаваемые между нодами n8n и затем в LLM, часто приводят к превышению лимитов токенов. Мы используем семантическое чанкирование данных перед векторизацией и динамическую суммаризацию наиболее релевантных фрагментов через промпты, чтобы уместить контекст в окно LLM без потери смысла. Также критична деградация JSON-схем в длинных цепочках: неаккуратная обработка данных в n8n-нодах может привести к изменению структуры JSON, что вызовет ошибки на последующих этапах. Строгая валидация схем и их версионирование — обязательная часть нашей методологии.

Эволюция SEO: От ключевых слов к Answer Engine Optimization

Традиционное SEO, сфокусированное на наборе ключевых слов, сегодня уступает место Answer Engine Optimization (AEO) и GEO. Критерием успеха становится способность системы давать точный, емкий ответ на сложный, многофакторный запрос пользователя. Контент, спроектированный как сущность (entity) в графе знаний, становится приоритетным для поисковых систем и AI-агентов. Создание контента, который понимает структуру бизнес-процесса и его контекст, является ключом к доминированию в поисковой выдаче 2026 года.

Автономные агенты, работающие в связке с n8n, способны не просто публиковать тексты, но и непрерывно анализировать эффективность каждого элемента контента, автоматически внося коррективы на основе обратной связи. Это превращает контент-маркетинг из статичного процесса в живую, самооптимизирующуюся экосистему. Важнейшим аспектом здесь выступает прозрачность принятия решений: система должна предоставлять интерпретируемые результаты, чтобы сотрудники могли отслеживать логику работы алгоритма и вносить правки в логику принятия решений, например, в логику переопределения релевантности для RAG-систем.

| Параметр | Legacy Approach | Linero Framework (Headless Orchestration) |

|---|---|---|

| Масштабируемость | Линейная, ограничена монолитом | Фрактальная, Edge-нативная |

| Управление данными | Статичные базы, реляционные связи | Vector Search + Knowledge Graph |

| Персонализация | Сегментация на основе тегов | Гиперконтекстуальная (Real-time RAG) |

| Интеграция | Хардкодные API-связи | Event-driven оркестрация (n8n) |

| SEO-подход | Keyword-density driven | Entity-based, Answer Engine Ready |

| Принятие решений | Реактивное, на основе отчетов | Проактивное, автономное (Agent-driven) |

Преодоление барьеров через пилотное проектирование

Масштабные внедрения ИИ-решений часто терпят крах из-за амбициозности и отсутствия промежуточных этапов. Инженерный подход предписывает использование пилотных проектов для верификации гипотез. На этом этапе оценивается не только экономическая эффективность, но и технологическая совместимость с существующей IT-инфраструктурой. Мы рекомендуем начинать с автоматизации узких, критически важных процессов, где ошибка наиболее дорогостояща, но легко отслеживаема. Это позволяет сформировать базовый ROI, подтвердив сокращение времени обработки данных на 60% и снижение ошибок ввода на 75% уже на начальных этапах.

Необходимо также учитывать человеческий фактор: успех автоматизации на 60% зависит от подготовки команды и её вовлеченности. Игнорирование этого аспекта ведет к саботажу внедрения. Крайне важно строить интерфейсы взаимодействия с системой так, чтобы сотрудники воспринимали AI-агентов как инструмент, облегчающий их работу, а не как угрозу своим компетенциям. Технологический базис должен быть подкреплен четкой методологией использования, где прописаны правила доступа и протоколы коррекции работы агентов в случае возникновения ошибок в AEO-системе.

Энергетическая и вычислительная оптимизация

В условиях прогнозируемого роста вычислительных затрат на обучение и инференс нейросетей, критически важной становится архитектурная экономия. Системный барьер — это неконтролируемый рост TCO (Total Cost of Ownership) из-за неэффективного использования ресурсов.

Для оптимизации используются модели типа Sparse Mixture of Experts (MoE), которые позволяют активировать только те параметры сети, что необходимы для решения конкретной задачи, значительно снижая потребление энергии и повышая скорость работы. Dynamic Neural Networks, способные менять свою топологию в зависимости от сложности запроса, позволяют избежать перегрузок и «нейро-голодания» в высоконагруженных системах. Это прямым образом влияет на unit-экономику данных, делая каждый запрос более выгодным.

Для достижения высокой производительности в NLP-задачах разработчикам стоит фокусироваться на использовании компактных архитектур, требующих меньше ресурсов для инференса при сохранении высокой точности. Ранний выход из слоев сети — технология, позволяющая прекратить вычисления, если модель уже достигла достаточной уверенности в ответе — должна стать стандартом для высоконагруженных систем. Такой подход не только экономит ресурсы, но и обеспечивает мгновенный отклик, критически важный для пользовательского опыта в интерфейсах нового поколения. Мы внедряем эти принципы при создании кастомных RAG-систем для B2B.

Оптимизация корпоративных процессов сегодня невозможна без перехода на Headless-архитектуру. Связка n8n как оркестратора, Vector Search как базы знаний и автономных AI-агентов формирует фундамент, на котором строится устойчивая к изменениям рынка модель. Успех проекта определяется не сложностью внедренной нейросети, а качеством связей между процессами и прозрачностью данных.

Для перехода к архитектуре будущего необходимо отказаться от монолитного мышления в пользу модульного. Компании, которые смогут внедрить инфраструктуру, где данные являются самодостаточными сущностями, а автоматизация — гибким потоком, получат значительное преимущество в доминировании в GEO и AI-ответах. Основной вектор развития — отказ от ручного управления каждым сценарием в пользу настройки правил оркестрации, которые позволяют системе самостоятельно адаптироваться под запросы пользователей. Технологическая чистота, подкрепленная строгим расчетом unit-экономики данных, является единственным путем к созданию жизнеспособной и масштабируемой системы в горизонте 2026 года.

Всякий проект автоматизации, лишенный глубокой инженерной проработки процессов на этапе планирования, обречен на финансовые потери, что подтверждается высокой долей неудачных внедрений в текущей рыночной среде. Готовы ли вы трансформировать свои бизнес-процессы, чтобы не просто выживать, но доминировать в новой AI-экономике?