Современные веб-сервисы сталкиваются с дефицитом адаптивности и скорости в условиях гиперконкуренции за поисковый трафик. Решение лежит в AI-Driven AIOps пайплайнах с n8n, которые позволяют автономно оптимизировать edge-нативные сервисы и CI/CD, что приводит к доминированию в SEO за счёт динамической персонализации и сверхбыстрой реакции на изменения поведенческих факторов.

AI-Driven AIOps в архитектуре Edge-Нативных Веб-Сервисов

Традиционные подходы к управлению производительностью и SEO базируются на статическом анализе и ручных корректировках. В 2026 году, когда 60% SEO-стратегий переходят на Adaptive Experimental Optimization (AEO) и 75% сайтов используют гибридные подходы (AEO, GEO, AI), эти методы критически неэффективны. Ручная адаптация контента и инфраструктуры к меняющимся запросам поисковых систем и пользовательскому поведению приводит к потере 30% органического трафика для сайтов с LCP выше 2.5 секунд. Медленное реагирование на микротренды и деградацию Core Web Vitals на уровне Edge лишает бизнес конкурентного преимущества.

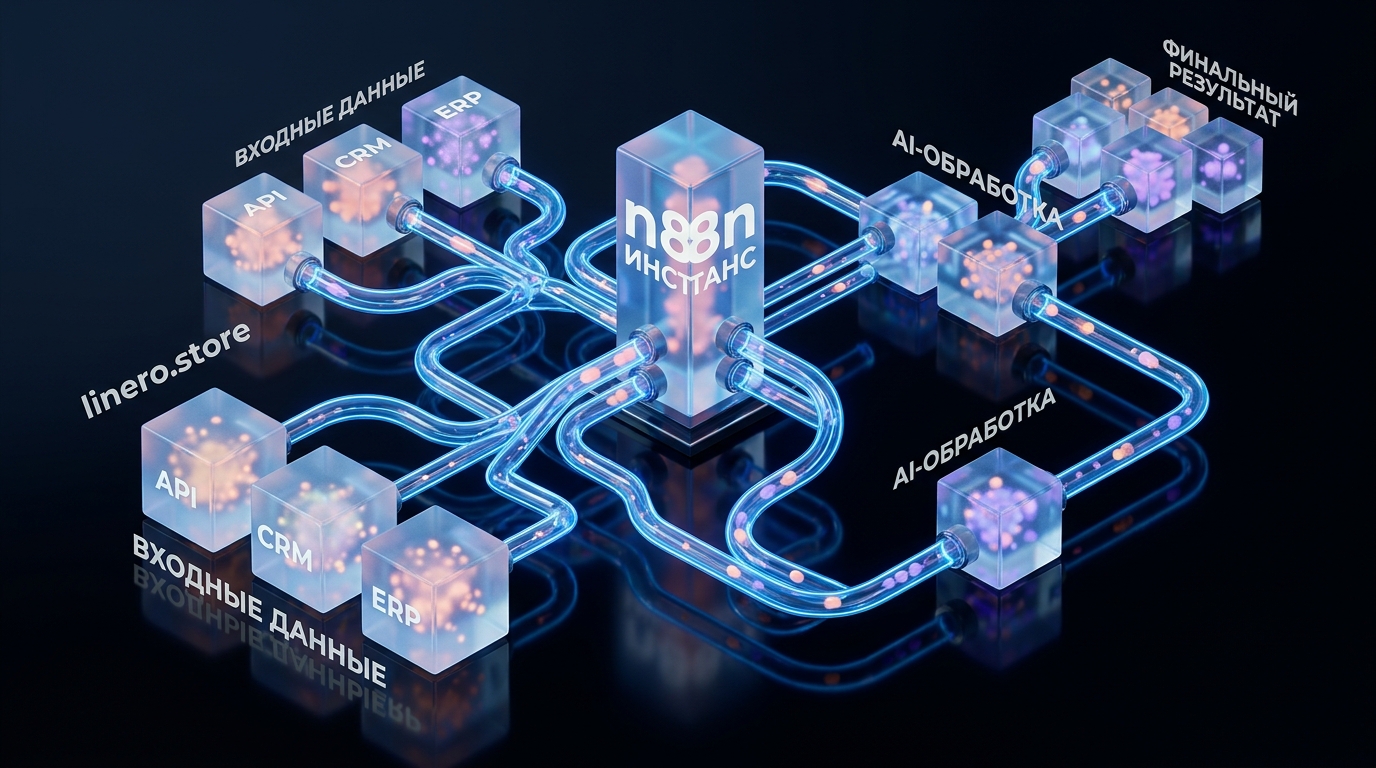

AI-Driven AIOps внедряет автономные циклы мониторинга, анализа и оптимизации непосредственно на периферии сети. Архитектура включает сбор метрик в реальном времени (LCP, INP, CLS, конверсия), обработку их AI-моделями (Transformer-XL++ с MoE для анализа пользовательских запросов до 100 000 токенов), и автоматическое развертывание оптимизаций через n8n. Это позволяет динамически адаптировать контент и конфигурации CDN к GEO-факторам и персонализированным AEO-экспериментам.

Применение AIOps позволяет достичь LCP менее 2.5 секунд, обеспечивая прирост органического трафика на 30%. Автоматизированные пайплайны сокращают время обработки лидов на 30–45% и увеличивают конверсию продаж на 22% за счет динамической персонализации контента и целевых предложений. AI-модели постоянно анализируют поведенческие метрики, выявляют аномалии и предлагают предиктивные меры, что снижает ошибки ввода данных на 65% в интегрированных CRM-системах.

Ядром системы является n8n, работающий на рекомендованных 4 ядрах CPU, 8 ГБ RAM и SSD, способный обрабатывать до 1000 задач в минуту. Для масштабирования применяется кластеризация n8n с использованием Redis для улучшения производительности. Интеграция с Edge-инфраструктурой (CDN, serverless-функции) осуществляется через API-first подход. Модели AI, такие как Transformer-XL++ с MoE, размещаются в высокопроизводительных вычислительных средах, обмениваясь данными с n8n через gRPC или REST API.

Пайплайны CI/CD для гипермасштабируемого SEO-доминирования

Традиционный CI/CD фокусируется на доставке кода, но игнорирует динамическую природу SEO в 2026 году. Ручное тестирование и A/B-тестирование не успевают за скоростью изменений в алгоритмах поисковых систем и пользовательском поведении. Отсутствие непрерывной оптимизации контента и архитектуры под влиянием AI-инструментов приводит к тому, что до 70% автоматизированных систем не достигают ожидаемых результатов из-за неправильной интеграции или отсутствия мониторинга.

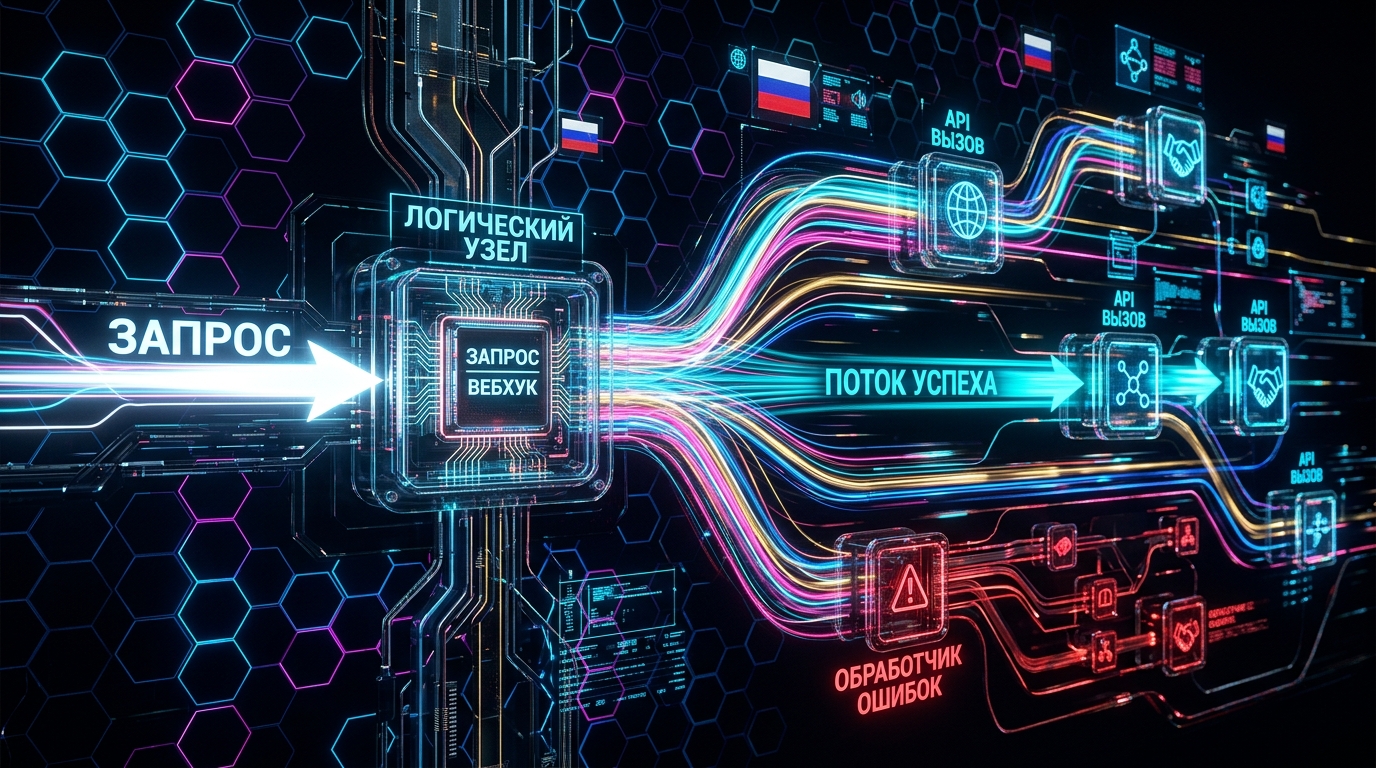

CI/CD пайплайны трансформируются в CI/CD/AIOps пайплайны. Любое изменение в коде или контенте, попадая в репозиторий, запускает не только стандартные тесты, но и серию AEO-экспериментов. n8n orchestrates:\n1. Автоматическое генерирование вариаций контента (с помощью LLM, обученных на Entity-based принципах).\n2. Деплой этих вариаций на сегменты аудитории через Edge-сервисы.\n3. Мониторинг Core Web Vitals и поведенческих метрик.\n4. Анализ результатов AI-моделью для определения наиболее эффективной вариации.\n5. Автоматический промоутинг лучшей вариации в продакшн.

Инженерная честность требует, чтобы каждый этап CI/CD/AIOps был измерим и обратим. Автоматизация без метрик — это хаос, а не оптимизация.

Эта модель позволяет достичь невиданной скорости адаптации к рыночным изменениям и запросам поисковых систем. Системы, использующие AI для анализа пользовательских запросов в реальном времени, динамически адаптируют контент, повышая релевантность и LCP. Постоянные AEO-эксперименты, проводимые n8n, позволяют мгновенно выявлять и внедрять наиболее эффективные подходы, что сокращает циклы оптимизации от недель до часов, и существенно повышает органический трафик.

n8n, как оркестратор, интегрируется с системами контроля версий (Git), платформами развертывания (Kubernetes, Vercel Edge Functions), системами мониторинга (Prometheus, Grafana), и AI-платформами. Для генерации контента используются LLM, такие как GPT-5.5-Turbo или Gemini 1.5 Pro, с контекстным окном до 100 000 токенов, применяя RAG-архитектуру для извлечения релевантных Entity-based данных. Минимальные требования для n8n — 2 ядра CPU, 4 ГБ RAM, 50 ГБ SSD, что делает его доступным для широкого внедрения.

Управление данными и комплаенс в AI-Driven AIOps

Увеличение количества параметров нейросетей до 100 триллионов к 2025 году увеличивает риски неконтролируемого поведения и ошибок. 72% маркетинговых компаний столкнутся с проблемами соответствия AI-технологий нормативным требованиям в 2025 году. Утечка данных, искажение информации и усиление стереотипов из-за смещённых данных — критические риски, которые могут привести к штрафам до 4% глобального оборота по GDPR или $2–5 млн по AI Act (EU). Недостаточная интеграция с CRM-системами, как отмечают 60% компаний, приводит к проблемам автоматизации.

Для обеспечения комплаенса и качества данных, каждый пайплайн AIOps должен включать автоматизированные этапы аудита и валидации. n8n интегрируется с системами управления данными (DMP, CDP) и специализированными AI-сервисами для проверки на AI bias, а также с системами логирования для документирования процессов принятия решений AI. Разработка «чек-листов по этике и прозрачности использования AI» в виде исполняемых n8n-воркфлоу становится стандартом.

Рекомендуется регулярно тестировать AI-модели на соответствие требованиям регуляторов, особенно при обработке персональных данных клиентов.

Внедрение таких пайплайнов позволяет не только соответствовать регуляторным нормам, но и повышать доверие клиентов за счёт прозрачности и этичности использования AI. Автоматические аудиты предотвращают утечку данных и минимизируют риски искажения информации. Это способствует снижению количества судебных исков, которые увеличились на 40% в 2025 году. Правильно настроенные системы избегают «чрезмерной автоматизации», сохраняя человеческое взаимодействие там, где это критично, и поддерживая гибкость, которая, как отмечают эксперты, часто отсутствует в 67% неудачных внедрений.

n8n используется для оркестрации процессов сбора согласий пользователей, анонимизации данных, выполнения запросов на удаление данных (GDPR). Он интегрируется с платформами Data Loss Prevention (DLP) и Compliance Management. AI-модели (например, Hybrid AI models) проходят регулярные ревалидации на предмет смещений, а результаты аудитов автоматически записываются в неизменяемые логи или блокчейн-реестры для обеспечения доказательной базы соответствия требованиям AI Act (EU).

Legacy Approach vs Linero Framework

| Критерий | Legacy Approach (2023) | Linero Framework (2026) |

|---|---|---|

| Оптимизация SEO | Ручной анализ, ключевые слова, медленное A/B-тестирование | AI-Driven AEO (60% стратегий), Entity-based контент, динамическая персонализация, CI/CD/AIOps с n8n, GEO-факторы |

| Реакция на изменения | Медленная, реактивная (недели/месяцы) | Гиперскоростная, проактивная (часы/минуты) за счёт n8n и LLM |

| Производительность (LCP) | Зависит от ручной оптимизации, часто > 2.5с | Целевой LCP < 2.5с (30% прирост трафика) за счёт Edge-оптимизации и AIOps |

| Лидогенерация/Конверсия | Ручная обработка, низкая адаптивность | Автоматизация (сокращение времени лида на 30-45%), персонализация AI (22% рост конверсии), n8n + CRM |

| Работа с данными AI | Ограниченные токены, риск bias, отсутствие комплаенса | Transformer-XL++ (100k токенов), MoE, встроенные AI-аудиты, GDPR/AI Act (EU) комплаенс через n8n-воркфлоу, документирование решений |

| Масштабирование n8n | Один сервер, ручная настройка | Кластеризация, Redis, нагрузочное тестирование, 1000 задач/мин (4C/8GB/SSD) |

| Гибкость автоматизации | Жесткие сценарии, отсутствие адаптации к специфике | Динамические пайплайны n8n, адаптация под специфику бизнеса, избегание «чрезмерной автоматизации» |

Инженерная практика: Преодоление реальных барьеров в AIOps-пайплайнах с n8n

Внедрение AI-Driven AIOps на базе n8n, несмотря на все преимущества, сопряжено с рядом специфических технических сложностей, с которыми сталкивается каждый практик.

Деградация JSON-структур при передаче между сервисами: Распространенная проблема — это несовместимость версий API или некорректная сериализация/десериализация JSON-объектов между n8n, LLM-сервисами и Edge-функциями. Например, при передаче сложных данных для персонализации контента, содержащих вложенные массивы или специальные символы, одна из систем может некорректно парсить JSON, что приводит к обрыву воркфлоу или искажению данных. Решение: строгая валидация схем JSON на каждом этапе, использование JSON-схем и трансформация данных внутри n8n с помощью специализированных нод для приведения к единообразному формату. Внедрение Pydantic-подобных валидаторов в коде, который вызывается n8n, критически важно.

Таймауты API и отвалы вебхуков: Когда n8n оркестрирует взаимодействие между множеством микросервисов, LLM и внешними API (например, для мониторинга Core Web Vitals или CDN-провайдеров), таймауты становятся обыденностью. Высоконагруженные LLM могут отвечать дольше ожидаемого, а внешние API могут временно быть недоступны. Это приводит к потере данных, незавершенным транзакциям и нарушению целостности AIOps-цикла. Практика показывает, что без должной обработки ошибок и механизмов повторных попыток (retries) в n8n (с экспоненциальной задержкой), а также внедрения Circuit Breaker паттернов для сильно загруженных сервисов, пайплайны оказываются ненадежными. Важно также настраивать асинхронную обработку событий через очереди сообщений (например, с использованием Redis, который улучшает производительность n8n при высоких нагрузках) для обеспечения отказоустойчивости при пиковых нагрузках или временных сбоях.

При работе с LLM, особенно когда речь идет о генерации или анализе большого объема контента для AEO-экспериментов (например, 100 000 токенов на запрос), легко превысить установленные провайдером лимиты или вызвать чрезмерные расходы. Несмотря на то, что Transformer-XL++ и MoE-архитектуры оптимизированы для длинных последовательностей, неправильная сегментация или агрегация данных может быстро исчерпать бюджет. В инженерной практике мы сталкиваемся с необходимостью тщательной токенизации и chunking’а входных данных перед отправкой в LLM, а также с динамической корректировкой объема запроса через n8n на основе оставшихся токенов. Иногда требуется рефакторинг промптов для более эффективного использования контекстного окна, чтобы минимизировать расходы и избежать ошибок.

Мы стоим на пороге эры, где гипермасштабируемое SEO-доминирование достигается не за счет «хаков» и ключевых слов, а через симбиоз автономных AI-систем и децентрализованной Edge-инфраструктуры. Вопрос не в том, будет ли AI управлять SEO, а в том, насколько быстро и эффективно ваша инфраструктура сможет адаптироваться к этому новому, динамичному миру.